Veröffentlicht: 14.07.2025 • Zuletzt bearbeitet: 24.02.2026

Die besten KI-Chatbots 2026 im Vergleich: Ein umfassender Leitfaden für das Zeitalter der KI-Systeme

Chatbots sind auch 2026 weit mehr als einfache Frage‑Antwort‑Maschinen: Sie kombinieren Multimodalität (Text, Sprache, Bild) und werden zunehmend zu Arbeitsassistenten, die Recherche, Strukturierung und Auswertung unterstützen – zum Beispiel über „Deep‑Research“-Funktionen, die Quellen durchsuchen und Ergebnisse mit Links belegen können. In der Praxis spart das Zeit, ersetzt aber keine Prüfung: Gerade bei News‑, Zahlen‑ und Rechtsfragen können KI‑Antworten trotz souveränem Ton falsch oder unvollständig sein. Eine verlinkte Untersuchung in diesem Artikel deutet darauf hin, dass die Fehlerquote bei nachrichtenbezogenen Fragen im untersuchten Test-Setup 2025 höher lag als 2024 – nimm das als Warnsignal und prüfe kritische Aussagen immer gegen Primärquellen. Ein Leistungsvergleich der KI-Modelle findet sich auf der Plattform LMArena.

Kurzfassung

KI-Chatbots 2026 sind mehr als Chatbots – sie kombinieren Multimodalität (Text, Bild, Audio, Video), Deep Research & Datenanalyse zu integrierten KI-Systemen.

Die wichtigsten Anbieter im Vergleich: ChatGPT, Gemini, Claude, Copilot, Perplexity, Grok, Mistral, Deepseek, Meta AI & Pi – jeder mit eigener Stärke und Philosophie.

⚠️ Kein Tool ersetzt kritisches Prüfen: Bei News-, Zahlen- und Rechtsfragen bleibt die Fehlerquote trotz souveränem Ton ein reales Risiko.

Update-Stand: 21.02.2026

- Anthropic: Claude Sonnet 4.6 (Feb 2026) – laut Anthropic Upgrade für Coding/Agent-Workflows; Sonnet 4.6 ist in claude.ai für Free/Pro als Standardmodell ausgerollt, 1M‑Token Kontextfenster ist als Beta erwähnt. https://www.anthropic.com/news/claude-sonnet-4-6

- Google: Gemini 3.1 Pro (Feb 2026) – laut Google Rollout/Preview über Gemini App/NotebookLM sowie Entwicklerzugänge (u. a. Gemini API/Vertex) und Benchmark-Angabe zu ARC‑AGI‑2 in der Ankündigung. https://blog.google/innovation-and-ai/models-and-research/gemini-models/gemini-3-1-pro/

Meine Empfehlung basierend auf meiner tagtäglichen Erfahrung

Wenn es darum geht, die richtigen KI-Modelle für verschiedene Aufgaben gezielt einzusetzen, habe ich inzwischen herausgefunden, welche Tools wirklich liefern – ohne dabei Kompromisse bei Qualität oder Natürlichkeit einzugehen.

- Allround & Kreativaufgaben: GPT‑5.2 – vielseitig, schnell, stark im Sprachverständnis.

- Programmierung & technische Inhalte: Claude (Opus/Sonnet‑Varianten) – logisch strukturiert, hochwertige Ergebnisse.

- Recherche & Faktensicherheit: Perplexity Pro – ideal für aktuelle Daten und Marktanalysen.

- Deutschsprachiger Content, der natürlich wirkt: Claude – erzeugt stilistisch saubere, kohärente Texte, die nicht nach generischer KI klingen.

- Bilder & visuelle Inhalte: Nanao Bana Pro oder GPT‑5.2 – beide liefern hochwertige, detailreiche Bilder auch mit deutschem Text, ideal für Blog, Social Media oder Präsentationen.

💡 Tipp: Klare Stil- und Tonvorgaben im Prompt („wie ein deutscher Fachjournalist“ oder „locker, aber professionell“) helfen, den KI-Look zu vermeiden. Oder noch besser ist ein Profil zu hinterlegen oder notfalls mit hochzuladen.

Der Kampf der KI-Systeme – Mehr als nur Chatbots

Die Welt der Künstlichen Intelligenz (KI) ändert sich rasend schnell. Deswegen müssen wir unsere Informationen ständig anpassen. Im Jahr 2026 geht es bei den KI-Assistenten nicht mehr nur um einzelne Chatbots, sondern um ganze KI-Systeme, die fest in unsere Arbeitsweise integriert sind. Welches Tool das „beste“ ist, hängt also weniger von einzelnen Funktionen ab, sondern vielmehr davon, wie du oder dein Unternehmen arbeiten und welche Arbeitsweise ihr bevorzugt. Diese Unterschiede sind der rote Faden für die Bewertung der KI-Chatbots 2026 und sollen dir helfen, eine fundierte Entscheidung zu treffen, die über eine reine Funktionsliste hinausgeht.

Was sind KI-Chatbots und wie haben sie sich 2026 entwickelt?

Die Technologie der KI-Chatbots 2026 entwickelte sich in den letzten Jahren enorm weiter. Ursprünglich waren sie nur Textgeneratoren, die auf großen Sprachmodellen (LLMs) basierten. Heute agieren sie als vielseitige, vorausschauende Assistenten. KI-Chatbots 2026 können nicht nur Text verstehen und schreiben, sondern auch Bilder, Audio und sogar Videos verarbeiten und erstellen. Diese Entwicklung ist entscheidend, denn sie bildet die Grundlage für die erweiterten Funktionen, die ich in diesem Bericht genauer vergleiche.

Der Übergang von „einzelnen Chatbots“ zu einer „tief integrierten KI-Landschaft“ zeigt, dass der Markt für KI-Chatbots 2026 reifer geworden ist. Anbieter unterscheiden sich jetzt durch umfassende Integration in Arbeitsabläufe, nicht nur durch einzelne Funktionen. Das bedeutet, dass deine Entscheidung für ein Tool immer mehr eine Entscheidung für eine ganze digitale Arbeitsphilosophie ist.

Das kann dich stärker an einen Anbieter binden, aber auch deine Produktivität innerhalb des gewählten Systems erheblich steigern. Wenn du dich für eine bestimmte „Arbeitsphilosophie“ entscheidest, wählst du damit eine ganze Reihe integrierter Tools und Dienste. Das führt zu einer tieferen Bindung an ein bestimmtes System, was einen späteren Wechsel erschweren könnte, aber gleichzeitig ein stimmigeres und produktiveres Nutzererlebnis bietet. Diese strategische Positionierung ist ein wichtiges Unterscheidungsmerkmal für die führenden KI-Chatbots 2026.

KI-Chatbots 2026: Top-Anbieter im Überblick – wer steckt dahinter und was ist ihre Idee?

Hier stelle ich dir die wichtigsten KI-Chatbots 2026 vor. Wir schauen uns an, welche Idee hinter jedem steckt und wofür sie sich am besten eignen.

Langdock & Mistral: Die souveräne KI-Kombi für deutsche KMU

Wenn du als KMU oder Selbstständige*r deine KI-Landschaft nicht nur testen, sondern wirklich souverän betreiben möchtest, empfehle ich dir besonders die Kombination aus der deutschen KI-Plattform Langdock und dem europäischen Modell Mistral AI. Langdock bietet dir eine zentrale, DSGVO-konforme Infrastruktur mit RAG-Anbindung an dein Firmenwissen, während Mistral als effizientes, europäisches Sprachmodell deine Prozesse schnell, kostengünstig und datensouverän unterstützt – ideal, wenn du KI produktiv in deine täglichen Arbeitsabläufe integrieren willst, ohne dich von einem einzigen US-Anbieter abhängig zu machen.

Warum Mistral in Langdock sein volles Potenzial entfaltet

Wenn du Mistral nicht nur als einzelnen Chatbot, sondern als festen Baustein deiner Unternehmens-KI nutzen möchtest, ist Langdock aus meiner Sicht die strategisch beste Heimat dafür. Du arbeitest dann mit Langdock als deutscher, DSGVO-konformer Plattform (inklusive AVV, europäischen Servern und RAG-Anbindung an Notion, Drive, Slack & Co.) und schaltest für sensible Vorgänge einfach konsequent auf Mistral-Modelle – so bleibt dein Wissen zu 100% im europäischen Rechtsraum, bist vor dem US Cloud Act geschützt und kannst trotzdem flexibel auch GPT‑5.2 oder andere Modelle zuschalten, wenn es fachlich sinnvoll ist.

ChatGPT: Die anpassbare KI-Werkstatt („Platform AI“)

OpenAI entwickelt ChatGPT zu einer vielseitigen KI-Plattform. Das bedeutet, ChatGPT ist nicht nur ein Chatprogramm, sondern eine Basis, auf der du neue Arbeitsabläufe mit Schnittstellen (APIs), Verbindungen und anpassbaren GPTs aufbauen kannst. Die Stärke von ChatGPT liegt in seiner Flexibilität und Erweiterbarkeit, die es Entwicklern und Kreativen ermöglicht, maßgeschneiderte KI-Lösungen für spezifische Anwendungsfälle zu entwickeln.

„Platform AI“ (Plattform-KI): Dieser Begriff bedeutet, dass ChatGPT nicht nur ein eigenständiges Produkt ist, sondern eine Grundlage oder ein „Betriebssystem“ für andere KI-Anwendungen und -Dienste. Es bietet Werkzeuge (APIs), die es Entwicklern ermöglichen, ChatGPT-Funktionen in ihre eigenen Programme zu integrieren. Außerdem kannst du „anpassbare GPTs“ erstellen, das sind spezialisierte Versionen von ChatGPT, die für bestimmte Aufgaben oder Themen trainiert wurden. Es ist also eine flexible Basis, auf der du aufbauen und eigene, maßgeschneiderte KI-Lösungen entwickeln kannst.

Möchtest du alle Details zu ChatGPT erfahren? Lies hier meinen umfassenden ChatGPT-Testbericht.

Google Gemini: Die smarte Schicht für deine Google-Apps („Workspace AI“)

Google hat am 19. Februar 2026 Gemini 3.1 Pro vorgestellt. Laut Google ist 3.1 Pro für Aufgaben gedacht, bei denen eine einfache Antwort nicht reicht, und wird als Preview in der Gemini API (AI Studio), Gemini CLI, Vertex AI/Gemini Enterprise sowie für Verbraucher über die Gemini App und NotebookLM ausgerollt. Auf ARC‑AGI‑2 nennt Google für Gemini 3.1 Pro einen Wert von 77,1% („verified“) und positioniert das Modell für komplexe Problemstellungen, bei denen eine kurze Antwort nicht reicht (Details in der offiziellen Ankündigung). Schaue dir dazu meinen Blogartikel zu Gemini an.

Claude (Anthropic): Der ethische KI-Assistent mit Constitutional AI („Safety-First AI“)

Claude von Anthropic positioniert sich als „Safety‑First“-Assistent (Constitutional AI) mit starkem Fokus auf Coding und zuverlässiges Reasoning. Neu ist seit 17. Februar 2026 Claude Sonnet 4.6: Laut Anthropic ist es ein Full‑Upgrade über Coding, Computer Use, Long‑Context‑Reasoning und Agent Planning hinweg und bringt ein 1M‑Token-Kontextfenster (beta). Für Free- und Pro‑Nutzer ist Sonnet 4.6 jetzt das Default‑Modell in claude.ai; preislich bleibt es wie Sonnet 4.5 (ab $3/$15 pro Million Tokens).

Anthropic hat Anfang Februar 2026 Claude Opus 4.6 vorgestellt und positioniert es als besonders stark für komplexe Aufgaben, agentische Workflows und Coding. Details (inkl. aktueller Einordnung und Benchmarks/Methodik) solltest du direkt aus der offiziellen Ankündigung bzw. den begleitenden System Cards übernehmen und im Artikel verlinken, weil einzelne Prozentwerte stark vom Test-Setup abhängen. Offizielle Quelle: https://www.anthropic.com/news/claude-opus-4-6

In meinem Blogartikel Claude von Anthropic findest du bald detaillierte Informationen zu den neusten Claude 4.6 Modellen und ein Vergleich zu GPT-5.2 und Gemini 3 Pro.

Microsoft Copilot: Dein KI-Helfer, der überall dabei ist („Ambient AI“)

Stell dir vor, KI ist überall da, wo du arbeitest – genau das ist Microsoft Copilot. Es ist nicht nur ein Chatbot, sondern ein Helfer, der direkt in Windows und deinen Microsoft 365 Programmen (wie Word oder Excel) eingebaut ist. Wenn du also viel mit Microsoft-Produkten arbeitest, macht unter den KI-Chatbots 2026 Copilot deinen Alltag am einfachsten und produktiver.

„Ambient AI“ (Umfassende/Allgegenwärtige KI): Dieser Begriff unterstreicht, dass Microsoft Copilot nicht nur eine einzelne Anwendung ist, die du bei Bedarf öffnest. Stattdessen ist es eine KI, die „um dich herum“ oder „im Hintergrund“ präsent ist und dich proaktiv in allen Aspekten deines digitalen Lebens unterstützt. Sie ist tief in das Betriebssystem (Windows) und die Produktivitäts-Apps (Microsoft 365) integriert. Das Ziel ist, dass die KI immer verfügbar ist und dir hilft, egal welche Aufgabe du gerade in welchem Programm erledigst, ohne dass du explizit danach fragen musst. Sie ist ein ständiger, intelligenter Begleiter.

Hier findest du einen detaillierten Bericht zu Microsoft Copilot

Perplexity AI: Die verlässliche Antwort-Maschine („Answer Engine“)

Perplexity AI ist unter den KI-Chatbots 2026 der Spezialist, wenn es um verlässliche Informationen geht. Es ist wie eine Suchmaschine, die dir nicht nur Antworten gibt, sondern dir auch genau zeigt, woher die Infos stammen. Wenn dir also Faktentreue und nachvollziehbare Quellen wichtig sind, ist Perplexity AI dein ideales Werkzeug für tiefgehende Recherchen.

„Answer Engine“ (Antwort-Engine): Dieser Begriff hebt hervor, dass Perplexity AI über eine traditionelle Suchmaschine hinausgeht. Während eine Suchmaschine dir eine Liste von Links liefert, fasst eine „Answer Engine“ die relevantesten Informationen aus verschiedenen Quellen zusammen und präsentiert dir eine direkte, prägnante Antwort. Das Besondere an Perplexity AI ist, dass es diese Antworten mit genauen Quellenangaben und Zitaten versieht. Das macht es zu einem vertrauenswürdigen Werkzeug für alle, die Wert auf Faktentreue und die Überprüfbarkeit von Informationen legen, wie zum Beispiel bei wissenschaftlichen oder journalistischen Recherchen.

Modellverfügbarkeit kann je nach Plan/Region variieren, siehe aktuelle Modellliste in Perplexity.

Erfahre mehr zu Perplexity, ich habe für dich die Antwort-Maschine im Detail recherchiert.

Grok (xAI): Der Rebell unter den KI-Chatbots

Grok von xAI (Elon Musks Firma) ist der Rebell unter den KI-Chatbots 2026. Seine Philosophie ist es, die „Wahrheit“ zu maximieren und auch „pikante“ Fragen zu beantworten, die andere KIs vielleicht ablehnen würden. Grok kann Texte und Bilder erstellen, Code schreiben und hat Zugriff auf Echtzeitdaten von X (ehemals Twitter). Wenn du also eine KI suchst, die weniger zensiert ist und auch mal unkonventionelle Antworten liefert, könnte Grok etwas für dich sein.

Mehr Informationen zu Elon Musks KI Grok kannst du in meinem ausführlichen Blogartikel finden

Mistral AI: Die effiziente und offene Alternative

Mistral AI ist ein europäischer Anbieter, der sich auf offene und effiziente KI-Modelle konzentriert. Sie wollen eine Alternative zu den großen Tech-Giganten bieten, indem sie Modelle entwickeln, die weniger Rechenleistung brauchen, aber trotzdem top Ergebnisse liefern. Mistral AI ist unter den KI-Chatbots 2026 super für Entwickler und Unternehmen, die viel Wert auf Anpassbarkeit, Transparenz und Kosteneffizienz legen. Es kann Texte verstehen und generieren, Code schreiben und sogar komplexe mathematische Probleme lösen.

Deepseek AI: Der Spezialist für Code und Mathematik

Deepseek AI setzt auf einen cleveren Ansatz namens „Mixture-of-Experts“. Das bedeutet, es hat viele spezialisierte „Experten“ im Hintergrund, die je nach Aufgabe aktiviert werden. Das macht Deepseek unter den KI-Chatbots 2026 besonders effizient und kostengünstig. DeepSeek hat im April 2025 ein neues Modell namens „DeepSeek-Prover-V2-671B“ vorgestellt, das auf formale Theorembeweise und mathematische Schlussfolgerungen spezialisiert ist. Dieses Modell soll die Fähigkeiten von DeepSeek im Bereich der mathematischen KI weiter ausbauen. Es ist auch Open-Source, was dir viel Freiheit bei der Anpassung gibt. Deepseek glänzt besonders bei Coding-Aufgaben, mathematischen Problemen und kann dir sogar seinen Denkprozess zeigen („Chain of Thought“).

Allerdings gibt es auch Bedenken hinsichtlich der Datensicherheit und des Datenschutzes im Zusammenhang mit DeepSeek. In Deutschland hat die Berliner Beauftragte für Datenschutz und Informationsfreiheit die App bei Google und Apple als rechtswidrigen Inhalt gemeldet; als Hintergrund wird u. a. eine rechtswidrige Übermittlung personenbezogener Daten nach China genannt, die Store‑Betreiber müssen den Hinweis prüfen und über Maßnahmen entscheiden. Ähnliche Bedenken wurden auch in anderen Ländern geäußert, darunter die USA, wo Gesetzgeber Gesetze vorgeschlagen haben, um die Nutzung von DeepSeek auf Regierungsgeräten zu verbieten.

Meta AI: Dein persönlicher KI-Assistent für Meta-Apps

Meta AI ist dein persönlicher KI-Assistent, der dich versteht und sich an deine Vorlieben anpasst. Es ist tief in die Meta-Apps wie Facebook, Messenger, Instagram und WhatsApp integriert. Meta AI nutzt die leistungsstarken Llama-Modelle, die auch Open-Source sind, und kann nicht nur Texte und Bilder erstellen, sondern auch Videos umgestalten und in Echtzeit übersetzen. Wenn du also viel in den Meta-Apps unterwegs bist und einen vielseitigen, lernfähigen Assistenten suchst, ist unter den KI-Chatbots 2026 Meta AI eine spannende Wahl.

Pi (Personal Intelligence): Dein empathischer Gesprächspartner

Pi ist dein persönlicher KI-Chatbot von Inflection AI, der sich besonders auf freundliche und einfühlsame Gespräche konzentriert. Er antwortet kurz und klar und ist damit ideal als Stimm-Assistent oder für emotionale Unterstützung. Pi merkt sich, was ihr besprochen habt, um Gespräche flüssiger zu gestalten, betont aber immer, dass er eine KI ist. Er generiert keine langen Texte oder Code, sondern ist unter den KI-Chatbots 2026 dein Begleiter für den täglichen Austausch.

Der große Direktvergleich der KI-Chatbots 2026

Der Kern dieses Berichts ist ein detaillierter Vergleich, der die entscheidenden Unterschiede der führenden KI-Chatbots 2026 auf einen Blick aufzeigt.

Vergleichstabelle: KI-Chatbots 2026 – Der strategische Direktvergleich

Die folgende Tabelle ermöglicht einen direkten Vergleich der wichtigsten KI-Chatbots 2026 anhand ihrer Kernphilosophie, Technologie, Alleinstellungsmerkmale, Multimodalität, Kosten und idealen Nutzerprofile. Die Struktur der Tabelle ist bewusst so gewählt, dass sie strategische Unterschiede hervorhebt, anstatt sich ausschließlich auf technische Daten zu konzentrieren. Die Spalten „Kernphilosophie & Strategie“ und „Ideales Nutzerprofil“ sind dabei besonders wertvoll, da sie eine Bewertung der strategischen Passform für individuelle Bedürfnisse ermöglichen. Hier findest du die Definition von Token.

| Tool/An-bieter | Kernphi-losophie & Strategie | Basis-technologie (Modelle) | Top-Allein-stel-lungsmerk-male (USPs) | Multi-modalität/ Leis-tungsum-fang | Kosten-loses Angebot | Preisge-staltung (Pro / Premium) | Ideales Nutzer-profil |

|---|---|---|---|---|---|---|---|

| ChatGPT | Anpassbare KI-Plattform („Platform AI“) | GPT-5.2, GPT-5o, o4-Series (Reasoning) | 100% AIME Mathe-Score; Höchste Reasoning-Tiefe; Agentic Workflows; Advanced Voice & Vision 2.0 | Text, Bild, Audio, Video (Echtzeit-Interaktion) | GPT-5.2 mit Nutzungslimits; SearchGPT; Datenanalyse | Go/Plus/Pro/Team: (8$, $20/Monat (Plus), $200/Monat (Pro), $25-30/Nutzer/Monat (Team) | Entwickler, Strategen, Content Creator & Power-User für Logik-Aufgaben |

| Google Gemini | Intelligente Schicht für Google Apps („Workspace AI“) | Gemini 3 Pro, Gemini 3 Flash, Veo 2, Imagen 3 | 2-Mio-Token-Kontextfenster; Deep Research Agent (93,8% GPQA); Native Android/Workspace Integration | Text, Bild, Audio, Video (Live-Stream-Analyse) | Gemini 3 Standard (Flash-basiert) | Gemini Advanced: $19.99/Monat (inkl. 2 TB Speicher) | Power-Nutzer von Google-Diensten, Forscher & Analysten (Video/große Dokumente) |

| Claude (Anthropic) | Ethischer KI-Assistent mit Constitutional AI („Safety-First AI“) | Claude Opus 4.6, Claude Sonnet 4.6, Claude Haiku 4.6 | Computer Use 2.0 (Desktop-Steuerung); Führend im Coding (80,9% SWE-bench); Extended Thinking Modus | Text, Bildanalyse, Autonome Computer-Steuerung | Kostenlos mit Claude Sonnet 4.6 (begrenzte Nutzung) | Pro: $20/Monat; Max: $100-200/Monat; Enterprise: individuell | Software-Engineers, Unternehmen in regulierten Branchen, Coding-Profis |

| Microsoft Copilot | Allgegenwärtiger KI-Assistent („Ambient AI“) | GPT-5.2, GPT-4o, DALL-E 4 Integration | Tiefe Windows 12 Integration; Microsoft 365 Agents; Enterprise-Sicherheit (Microsoft Graph) | Text, Bild, Audio, Video-Editing (Clipchamp Integration) | Integrierte Version in Windows & Edge (mit Limits) | Copilot Pro: $20/Monat | Unternehmen & Einzelanwender im Microsoft-Ökosystem (Office, Windows) |

| Perplexity AI | Verifizierte Antwort-Maschine („Answer Engine“) | Eigene Modelle + GPT-5.2, Claude 4.6, Llama 4 (Modelle variieren je nach Region | „Pro Search“ mit Agentic-Step-Recherche; Verifizierbare Quellen; Finanz- & Akademik-Fokus | Text, Bildanalyse, strukturierte Reports | Umfassende kostenlose Recherche (Standard) | Pro: $20/Monat; Max: $200/Monat | Forscher, Journalisten, Studenten, Fakten-Checker |

| Grok (xAI) | Der Rebell: Maximale Wahrheit & Echtzeit-Daten | Grok 4.5 (Generalist, Code, Heavy) | Echtzeit-X-Datenzugriff; Minimale Zensur; Deep Search 2.0; Native Integration in Tesla/X | Text, Bild, Audio, Video, Live-Kamera-Analyse | Kostenlos auf X (mit Limits) | X Premium+: $16/Monat; SuperGrok: $300/Monat | Nutzer, die ungefilterte Echtzeit-Infos & maximale Rechenpower suchen |

| Mistral AI | Effiziente & offene KI-Modelle | Mistral Large 3, Pixtral, Mistral NeMo 2 | Souveränität & Datenschutz; Optimiert für On-Premise; Starke Mehrsprachigkeit | Text, Bildanalyse, Code | Open-Source-Modelle via Le Chat | API-basiert (Pay-per-Token); Enterprise-Lizenzen | Entwickler, europäische Unternehmen (DSGVO-Fokus), Tech-Puristen |

| Deepseek AI | Spezialisierte Experten & Kosteneffizienz | DeepSeek-V4, DeepSeek-R2 (Reasoning) | Extrem effiziente MoE-Architektur; Open-Weights; Führendes Preis-Leistungs-Verhältnis | Text, Bildanalyse, High-End Coding | Modelle frei verfügbar via API/Web | API-Nutzung (extrem kostengünstig) | Datenanalysten, Mathematiker, preisbewusste Entwickler |

| Meta AI | Persönlicher KI-Assistent für Meta-Apps | Llama 4 (Full Release) | Open-Source-Champion; Native Integration in WhatsApp/Instagram; Weltklasse-Multimodalität | Text, Bildgenerierung, Video-Restyling, Real-time Translation | Kostenlos in Meta-Apps & als Open-Source | Kostenlos; Llama API (kostenbasiert) | Kreative, Nutzer von Meta-Apps, Entwickler offener Systeme |

| Pi (Personal Intelligence) | Dein empathischer Gesprächspartner | Inflection-3 (Agentic Update) | Höchste emotionale Intelligenz (EQ); Proaktive Assistenz; Menschliche Stimme | Text, Audio (Advanced Voice) | Kostenlos (mit Nutzungslimits) | Fokus auf Enterprise-Integration & B2B | Nutzer, die emotionalen Support oder einen proaktiven Life-Coach suchen |

Die Betonung der „Kernphilosophie & Strategie“ und des „Idealen Nutzerprofils“ in der Tabelle, anstatt nur technischer Spezifikationen, stellt einen entscheidenden Rahmen für fundierte Entscheidungen dar. Dies bedeutet, dass der „beste“ KI-Chatbots 2026 für einen Nutzer durch dessen bestehendes digitales System und seine Arbeitsgewohnheiten bestimmt wird. Die Entscheidung geht somit über einen einfachen Funktionsvergleich hinaus und wird zu einer ganzheitlicheren Frage der „Passform“.

Detaillierte Analyse der Vergleichskriterien der KI-Chatbots 2026

Jeder Aspekt aus der Vergleichstabelle der KI-Chatbots 2026 wird im Folgenden in eigenen Unterabschnitten vertieft, um technische Unterschiede und praktische Implikationen verständlich einzuordnen.

Technologie-Showdown: GPT-4o vs. Gemini 3 Pro vs. GPT-5.x

Führende KI-Chatbots 2026: Architektur, Stärken und reale Unterschiede

Die Leistungsfähigkeit moderner KI-Chatbots im Jahr 2026 hängt weniger von einzelnen „Magic Features“ ab als von ihren zugrunde liegenden Modellarchitekturen, Trainingsansätzen sowie Optimierungen für Reasoning, Multimodalität und Kontextverarbeitung. Besonders relevant sind dabei die OpenAI-Modelle der GPT-4o- und GPT-5-Generation sowie Googles Gemini-Reihe.

OpenAI: Von GPT-4o zu GPT-5.x

GPT-4o („Omni“) markierte einen wichtigen architektonischen Schritt. Das Modell wurde end-to-end multimodal trainiert und kann Text, Bilder und Audio nicht nur getrennt verarbeiten, sondern gemeinsam interpretieren und erzeugen. Dadurch wirken Interaktionen natürlicher, insbesondere bei Spracheingaben, Übersetzungen und nicht-englischen Sprachen. Gegenüber GPT-4 Turbo bot GPT-4o vergleichbare Text- und Code-Leistung, war jedoch schneller und kosteneffizienter in der API.

Mit den neueren GPT-5-Varianten liegt der Fokus stärker auf robustem Reasoning, Werkzeugnutzung und agentischen Fähigkeiten. Diese Modelle sind darauf optimiert, komplexe mehrstufige Aufgaben konsistenter zu lösen, längere Arbeitskontexte zu halten und Fehlerketten zu reduzieren. In anspruchsvollen mathematischen und logischen Benchmarks zeigen sie stabilere Ergebnisse als frühere Generationen, wobei viele Leistungswerte aus Hersteller- oder Laborbenchmarks stammen und entsprechend eingeordnet werden sollten.

Google Gemini: Thinking Models und Langkontext

Google positioniert Gemini 2.5 Pro und Gemini 3 explizit als sogenannte Thinking Models. Gemeint ist damit eine Architektur, die stärker auf Planung, interne Zwischenschritte und Konsistenz bei komplexen Aufgaben ausgelegt ist.

Besonders hervorzuheben sind:

- sehr starke Leistungen in wissenschaftlichen Benchmarks wie GPQA (Graduate-Level Science Q&A)

- solide Ergebnisse in anspruchsvollen Mathematik-Benchmarks wie AIME

- eine außergewöhnlich große Kontextlänge, die je nach Modellvariante bis in den Bereich sehr großer Tokenmengen reicht

Diese Langkontext-Fähigkeit macht Gemini besonders interessant für:

- große Codebasen

- umfangreiche Dokumente

- wissenschaftliche oder juristische Analysen über viele Quellen hinweg

Ein weiterer Fokus liegt auf besser nachvollziehbaren Antworten und der Reduktion von Quellenhalluzinationen, insbesondere in wissensintensiven Anwendungsfällen. Auch hier bleibt die Qualität stark vom konkreten Use Case und den bereitgestellten Daten abhängig.

Benchmarks: GPQA und AIME kurz eingeordnet

GPQA testet tiefes naturwissenschaftliches Verständnis auf Graduate-Niveau und gilt als anspruchsvoll für Modelle, die sich primär auf oberflächliches Pattern-Matching stützen.

AIME erfordert mehrstufiges mathematisches Denken ohne Hilfsmittel und ist ein guter Indikator für strukturiertes Reasoning, allerdings kein vollständiges Maß für allgemeine Intelligenz oder Praxistauglichkeit.

Hohe Scores in diesen Benchmarks zeigen Fortschritte im logischen Denken, sagen jedoch nur begrenzt etwas über Alltagstauglichkeit, Zuverlässigkeit oder Wirtschaftlichkeit aus.

Einordnung statt Hype

Für 2026 lässt sich festhalten:

- OpenAI-Modelle sind besonders stark bei allgemeinem Reasoning, Tool-Integration, Coding-Workflows und agentischen Anwendungen.

- Gemini-Modelle spielen ihre Stärken vor allem bei Langkontext, Wissenschaft, Multimodalität und strukturiertem Denken aus.

- Die Unterschiede zeigen sich weniger in „kann vs. kann nicht“, sondern in Stabilität, Skalierung und Passung zum jeweiligen Use Case.

Der wichtigste Punkt bleibt:

Benchmarks sind Orientierungshilfen – der reale Mehrwert entsteht erst durch saubere Prozesse, gutes Prompt-Design und eine klare Vorstellung davon, wofür ein Modell konkret eingesetzt werden soll.

Weitere relevante KI-Chatbots 2026 im Überblick

Perplexity AI

Perplexity AI nutzt unter den KI-Chatbots 2026 eine Hybridstrategie, indem es eigene Modelle mit den besten externen Modellen wie GPT-5.2, Claude 4.6 und Gemini 3.1 Pro kombiniert, um seinen Fokus auf Recherche und verifizierbare Antworten zu unterstützen. In der Pro-Version lässt sich auch einfach ein Modell auswählen.

Grok 4

Grok 4 wurde am 9. Juli 2025 von xAI vorgestellt und ist das neueste Flaggschiffmodell. Es zeichnet sich durch eine hybride Architektur mit spezialisierten Modulen und einer beeindruckenden Skalierung von etwa 1,7 Billionen Parametern aus. Grok 4 verfügt über dedizierte „Attention Heads“ für mathematisches Denken, Codegenerierung und natürliches Sprachverständnis. Es bietet laut Teslarati.com verbesserte Argumentationsfähigkeiten und übertrifft in Benchmarks wie ARC-AGI-2 und Humanity’s Last Exam (text-only subset) andere Modelle, teilweise sogar ohne den Einsatz von Tools.

Grok 4 ist gemäß analyticsindiamag.com in der Lage, Probleme zu lösen, die es zuvor nicht gesehen hat, und wird als „smarter als fast alle Doktoranden in allen Disziplinen gleichzeitig“ beschrieben. Eine spezialisierte „Grok 4 Code“-Version ist für August geplant, und ein multimodaler Agent für September.

Mistral AI

Mistral AI konzentriert sich auf die Entwicklung von Modellen, die mit weniger Rechenressourcen Spitzenleistungen erbringen und große Kontextfenster (bis zu 128.000 Tokens) verarbeiten können.

Deepseek AI

Deepseek AI nutzt einen Mixture-of-Experts (MoE) Ansatz, bei dem nur die relevantesten Parameter für jede Aufgabe aktiviert werden, was die Effizienz steigert. Es ist besonders stark in mathematischen Berechnungen und Coding-Aufgaben.

Meta AI

Meta AI basiert auf den Llama-Modellen, die eine Mixture-of-Experts (MoE) Architektur nutzen laut Meta AI und bis zu 2 Billionen Parameter umfassen können. Llama 4 Modelle sind nativ multimodal und unterstützen ein Kontextfenster von bis zu 10 Millionen Tokens, was sie für lange Dokumentenanalysen und komplexe Aufgaben sehr effizient macht.

Pi

Pi läuft seit März 2024 mit der Version Inflection-2.5, die leistungstechnisch nahe an OpenAI’s GPT-4 heranreicht. Inflection AI entwickelt zudem neuere Modelle basierend auf der Mixture-of-Experts-Architektur, es ist jedoch noch offen, ob diese künftig in Pi integriert werden.

Spezialisierung der KI-Modelle

Die Entwicklung von Modellen wie GPT-4.5 oder GPT 5.2 (gut für Intuition, Kreativität und breites Wissen) und o3-pro (für präzise, tiefe Schlussfolgerungen und komplexe STEM-Probleme) durch OpenAI zeigt, dass sich KI-Modelle immer mehr spezialisieren. Das bedeutet, du musst die Stärken der verschiedenen Modelle kennen, um die beste Leistung für deine Aufgaben zu erzielen. Die Idee, dass ein einziger KI-Chatbot 2026 alles kann, weicht der Erkenntnis, dass es für verschiedene Aufgaben unterschiedliche Spezialisten gibt.

Ein zentraler Aspekt dieser Spezialisierung ist die Fähigkeit zu Deep Research und Reasoning (logischem Denken). Modelle wie o3-pro sind darauf ausgelegt, „gestochen scharfe, tiefe Schlussfolgerungen“ zu ziehen und komplexe Probleme, insbesondere in den STEM-Bereichen, zu lösen. Dies erfordert nicht nur ein breites Wissen, sondern auch die Fähigkeit, Informationen zu analysieren, zu verknüpfen und schrittweise zu einer Lösung zu gelangen – also „länger zu denken“ oder eine „Chain of Thought“ zu entwickeln. Grok 4 beispielsweise hat seine Argumentationsfähigkeiten deutlich verbessert und kann Probleme lösen, die es zuvor nicht gesehen hat, was ein hohes Maß an Reasoning beweist.

Die beeindruckende Leistung von GPT-4 (und damit auch GPT-4o) bei professionellen und akademischen Tests, wie dem Bestehen des Anwaltsexamens im oberen 10-Prozentbereich, zeigt, dass KI nicht mehr nur Inhalte generiert, sondern auch komplexe Probleme lösen und Wissen anwenden kann. Das hat große Auswirkungen darauf, wie Experten KI in ihre Arbeit einbinden werden – nicht nur zur Automatisierung, sondern als echten „Co-Piloten“ bei schwierigen Aufgaben.

Was ist STEM? STEM ist eine Abkürzung für die englischen Begriffe Science (Naturwissenschaften), Technology (Technologie), Engineering (Ingenieurwesen) und Mathematics (Mathematik). Es handelt sich um einen Überbegriff, der diese vier eng miteinander verbundenen Fachbereiche zusammenfasst. In diesen Bereichen sind oft präzise Logik, Problemlösung und tiefes Fachwissen gefragt, weshalb spezielle KI-Modelle hier besonders leistungsfähig sein müssen.

Multimodalität im Fokus: Bild-, Video- und Audio-Generierung

Die Fähigkeit der KI-Chatbots 2026, über Text hinaus auch Bilder, Videos und Audio zu verstehen und zu generieren, ist ein entscheidender Wettbewerbsfaktor.

ChatGPT (GPT-5.2) das allerneuste Modell, erschienen Dez. 2025) ist noch näher zu erkunden.

ChatGPT (GPT-4o) akzeptiert und generiert jede Kombination aus Text, Audio, Bild und Video. Die neue End-to-End-Trainingsmethode ermöglicht es dem Modell, Ton, mehrere Sprecher und Hintergrundgeräusche direkt zu beobachten und Emotionen auszugeben. GPT‑4o erkennt automatisch mehrere Sprecher und analysiert Hintergrundgeräusche. Auch kannst du Audiodateien hochladen – das Modell transkribiert sie, unterscheidet Stimmen und liefert Zusammenfassungen oder Analysen. Ferner ersetzt die native Bildgenerierung den älteren DALL-E-3-Workflow.

Microsoft Copilot integriert GPT-4o Image Generation (als Nachfolger von DALL-E 3) für die Bilderstellung und bietet unter den KI-Chatbots 2026 eine schnellere Bildgenerierung mit dem „Image Creator from Designer“.

Google Gemini nutzt Veo 3 für die Videogenerierung, wodurch 8-sekündige Videoclips mit Sound aus einzelnen Fotos oder Textprompts in 720p MP4-Auflösung erstellt werden können. Für die Bildgenerierung kommt Imagen zum Einsatz, das Text-zu-Bild-Erstellung, Bildbearbeitung und Upscaling ermöglicht. Videos, die mit Veo in der Gemini-App generiert werden, sind mit einem sichtbaren Wasserzeichen und SynthID, einem digitalen Wasserzeichen in jedem Frame, versehen, um ihre KI-Generierung anzuzeigen.

Perplexity AI unterstützt unter den KI-Chatbots 2026 ebenfalls Text-, Bildanalyse- und Bildgenerierungsfunktionen.

Grok 4 ist vollständig multimodal und kann Inhalte über Text, Bild, Audio und Video hinweg analysieren und generieren. Es kann fotorealistische Bilder aus Textbeschreibungen erstellen, künstlerische Renderings in verschiedenen Stilen generieren, Memes und Illustrationen erstellen sowie realistische Porträts produzieren. Es bietet unter den KI-Chatbots 2026 auch Bildbearbeitungsfunktionen wie das Ändern von Hintergründen, das Modifizieren von Bildstilen und das Hinzufügen oder Entfernen von Elementen. Grok 4 kann zudem den visuellen Inhalt von Bildern analysieren, nicht nur den Text. Eine verbesserte Sprachfunktion mit mehr Realismus und Reaktionsfähigkeit sowie die Fähigkeit, Live-Einblicke aus Kamerabildern zu ziehen, sind ebenfalls Teil von Grok 4.

Mistral AI verfügt über multimodale generative Fähigkeiten, die es ihm ermöglichen, neue Inhalte in verschiedenen Medienformen zu synthetisieren.

Deepseek AI bietet ebenfalls multimodale Fähigkeiten.

Meta AI ist nativ multimodal, was bedeutet, dass es Text, Bilder, Audio und Video verarbeiten und generieren kann. Es kann fotorealistische Bilder aus Textprompts erstellen und bietet Video-Restyling-Funktionen, um Hintergründe, Beleuchtung und Outfits in Videos zu ändern.

Die „Omni“-Fähigkeiten von GPT-4o und sein End-to-End-Training über Text, Audio, Bild und Video hinweg stellen einen bedeutenden Fortschritt in Richtung natürlicherer Mensch-Computer-Interaktion dar, die über einfache Text-Chats hinausgeht. Dies deutet darauf hin, dass zukünftige KI-Schnittstellen hochintuitiv und konversationsorientiert sein werden, was die kognitive Belastung für die Nutzer reduziert und komplexere, kollaborative Echtzeitaufgaben ermöglicht, die der menschlichen Kommunikation ähneln.

Die Integration von Veo 3 in Google Gemini für die Foto-zu-Video-Generierung verdeutlicht die schnelle Entwicklung der KI über die Text- und Bildgenerierung hinaus zu dynamischen Medien. Diese Fähigkeit transformiert Content-Erstellungsworkflows, indem sie es Nutzern ermöglicht, visuelle Erzählungen schnell zu prototypisieren und das digitale Storytelling zu verbessern. Gleichzeitig ergeben sich neue Überlegungen für den ethischen Einsatz von KI-Chatbots 2026, wie das Verbot der Erstellung von Videos von öffentlich identifizierbaren Personen und die Verwendung von Wasserzeichen.

Recherche-Power: Welcher KI-Chatbot punktet bei normaler und Deep Research?

Die Eignung eines Chatbots für alltägliche Suchanfragen im Vergleich zu komplexen, tiefgehenden Recherchen variiert erheblich.

Für die normale Recherche bieten alle führenden KI-Chatbots 2026 solide Funktionen. ChatGPT (GPT-4o) ermöglicht eine umfassende Nutzung mit Limits in der kostenlosen Version, verfügt über eine Memory-Funktion, die sich an frühere Konversationen erinnert, und erweiterte Datenanalysefähigkeiten. Microsoft Copilot ist umfassend in Edge und Windows verfügbar und bietet grundlegende Suchfunktionen. Google Gemini stellt sein Standardmodell für die allgemeine Nutzung bereit. Perplexity AI bietet eine umfassende kostenlose Recherche mit Nutzungslimits.

Deep Research – Übersichtstabelle

Im Bereich der Deep Research zeigen sich deutliche Unterschiede. Hier ist eine detaillierte Übersicht der Modelle, die sich für tiefgehende Recherche eignen (Stand August 2025):

| Tool/Anbieter | Kernphilosophie & Strategie | Basis-Technologie (Modelle) | Top-Alleinstellungsmerkmale (USPs) | Multimodalität / Leistungsumfang | Kostenloses Angebot | Preisgestaltung (Pro / Premium) | Ideales Nutzerprofil |

|---|---|---|---|---|---|---|---|

| ChatGPT (OpenAI) | Anpassbare KI‑Plattform („Platform AI“) | OpenAI‑Modelle (je nach Plan/Modus; u. a. General‑Modelle + Reasoning‑Varianten) | Sehr flexibel (Custom GPTs/Agents); stark in Tool‑Nutzung, Reasoning & Automationen; großes Ökosystem (API, Integrationen) | Text, Bild, Audio (je nach Plan auch erweiterte multimodale Funktionen) | Ja, mit Limits (Funktionen/Modelle variieren) | Mehrere Pläne (Free/Plus/Pro/Team/Enterprise; Preise ändern sich häufig) | Entwickler, Strategen, Content‑Creator, Power‑User; Teams mit Automations-/Agent‑Use‑Cases |

| Google Gemini | KI‑Schicht für Google‑Apps („Workspace AI“) | Gemini‑Modellfamilie (z. B. Pro/Flash‑Varianten; je nach Region/Produkt) | Enge Integration in Google‑Ökosystem (Workspace/Android); stark bei großen Dokumenten & Kontext; gute Research‑Workflows (je nach Produkt) | Text, Bild, Audio; teils Video/Streams abhängig von Produkt/Region | Ja, mit Limits | „Advanced“/Workspace‑Pläne je nach Land/Bundle (z. B. inkl. Speicher) | Power‑Nutzer von Google‑Diensten, Analysten, Research‑Workflows, Dokument‑Heavy‑Arbeit |

| Claude (Anthropic) | Safety‑First‑Assistent (Constitutional AI) | Claude‑Modellfamilie (z. B. Opus/Sonnet/Haiku; Versionen variieren) | Sehr stark in Coding & strukturiertem Denken; gute Schreibqualität; Fokus auf Sicherheit/Policy‑Konformität; Tool-/Agent‑Ansätze je nach Plan | Text, Bildanalyse; je nach Produkt/Plan zusätzliche Tools | Ja, mit Limits | Pro/Max/Team/Enterprise (Preise je nach Region/Plan) | Software‑Teams, regulierte Branchen, Nutzer mit Fokus auf saubere Texte/Coding |

| Microsoft Copilot | Allgegenwärtige KI im Microsoft‑Ökosystem („Ambient AI“) | Microsoft‑Copilot basiert auf mehreren Modellen/Services (je nach Produkt/Plan) | Tiefe Integration in Windows & Microsoft 365; starke Unternehmensfeatures (Identität, Compliance, Admin); gut für Office‑Produktivität | Text, Bild; je nach App weitere Medienfunktionen | Basis‑Copilot/Edge/Windows oft mit Limits | Copilot‑Pläne für Privat & Business (z. B. Copilot Pro/M365‑Add‑ons) | Unternehmen & Einzelanwender im Microsoft‑Ökosystem (Office/Teams/Windows) |

| Perplexity AI | Antwortmaschine mit Quellen („Answer Engine“) | Mix aus eigenen + externen Modellen (Auswahl variiert nach Plan/Region) | Sehr gut für Web‑Recherche mit Quellen; schnelle Zusammenfassungen/Reports; guter „Search‑First“-Workflow | Text; teils Bildanalyse/Datei‑Workflows je nach Plan | Ja, solide Free‑Nutzung | Pro/Max‑Stufen je nach Angebot | Research, Journalismus, Studium, Faktencheck, „Antwort mit Quellen“-Use‑Cases |

| Grok (xAI) | Rebell + Echtzeit‑/X‑Nähe | Grok‑Modellfamilie (Versionen/Bezeichnungen ändern sich) | Starker Echtzeit-/X‑Bezug (je nach Produkt); eher „ungefilterter“ Stil; Fokus auf schnelle, aktuelle Diskussionen | Text, Bild (weitere Modalitäten je nach Ausbaustufe/Produkt) | Teilweise über X‑Pläne, mit Limits | X‑Premium‑Pläne; ggf. zusätzliche Grok‑Stufen | Nutzer, die Echtzeit‑Kontext/Trends wollen; Social‑Media‑nahe Recherche |

| Mistral AI | Effiziente & offene Modelle (EU‑Alternative) | Mistral‑Modelle (z. B. Large‑Linie + multimodale Modelle; je nach Release) | EU‑Fokus & Optionen für mehr Souveränität; oft gute Preis/Leistung; Open/gewichtsoffene Ansätze (modellabhängig) | Text; je nach Modell Bild/Code | Le Chat/öffentliche Demos & Open‑Modelle (modellabhängig) | API‑basiert + Enterprise‑Optionen | Entwickler, europäische Unternehmen (DSGVO‑Denke), Kosten-/Souveränitäts‑Fokus |

| DeepSeek | Spezialist (Code/Mathe) + Effizienz | DeepSeek‑Modelle (Versionen variieren; teils Open‑Weights) | Oft sehr stark bei Coding/Mathe; effiziente Architekturen; preislich häufig attraktiv (API‑abhängig) | Text; je nach Modell Bild/Code | Häufig Demos/API‑Zugänge (modellabhängig) | Token-/API‑basiert; Preise variieren | Datenanalysten, Mathematik-/Coding‑Use‑Cases, preisbewusste Entwickler (mit Blick auf Datenschutzrisiken) |

| Meta AI | Assistent in Meta‑Apps + Llama‑Ökosystem | Llama‑Modellfamilie (modell-/releaseabhängig; teils Open) | Tiefe Integration in WhatsApp/Instagram/Facebook; starkes Open‑Ökosystem rund um Llama (modellabhängig) | Text, Bild (weitere Modalitäten abhängig von Modell/Produkt) | In Meta‑Apps typischerweise kostenlos | Nutzung in Apps meist kostenlos; API/Hosting kostenbasiert | Kreative & Meta‑App‑Power‑User; Entwickler, die auf offene Modelle setzen |

| Pi (Inflection) | Empathischer Gesprächspartner | Inflection‑Modelle (Versionen variieren) | Fokus auf Gespräch, Tonalität, „companionship“/Support; eher weniger Tool‑/Pro‑Workflows | Text, Audio (produktabhängig) | Ja, mit Limits | Business-/Enterprise‑Ausrichtung möglich; Consumer‑Pläne variieren | Nutzer, die Begleitung/Kommunikation wollen; wenig Bedarf an Coding/Tool‑Automation |

Transparenz-Hinweis (Stand: 21.02.2026): Modelle, Features, Limits und Preise ändern sich bei allen Anbietern häufig und sind teils nach Region/Account/Plan gestaffelt; die Tabelle ist deshalb eine Momentaufnahme und dient der Orientierung. Bei „Multi‑Modell“-Tools (z. B. Perplexity) kann sich das konkret verwendete Modell je nach Modus/Abonnement unterscheiden. Ergebnisse aus Benchmarks sind nur eingeschränkt vergleichbar (anderes Test‑Setup, Prompting, Tool‑Zugriffe) – für Kaufentscheidungen bitte immer die aktuellen Anbieter-Seiten prüfen. Für Tools mit möglichen Datenschutz-/Drittlandtransfer‑Risiken (z. B. DeepSeek) gilt: vor produktiver Nutzung mit personenbezogenen Daten die rechtliche Lage/AVV/Transfermechanismen prüfen; es gab hierzu in Deutschland bereits behördliche Schritte/Meldungen.

Deep Research im Detail

Gemini 2.5 Pro besitzt die außergewöhnliche Fähigkeit, riesige Kontextmengen zu verarbeiten und zu nutzen (bis zu 1 Million Tokens), und definiert die Möglichkeiten der „Deep Research“ für KI grundlegend neu. Dies erlaubt eine umfassende Analyse ganzer Dokumente, Codebasen oder ausgedehnter Konversationen, ohne den Zusammenhang zu verlieren, und macht es einzigartig geeignet für Aufgaben wie die Überprüfung juristischer Dokumente, die Synthese wissenschaftlicher Literatur oder komplexe Datenanalysen.

Die Unterscheidung zwischen GPT-4.5’s „breitem Wissen“ und o3-pro’s „gestochen scharfer, tiefer Schlussfolgerung“ verdeutlicht, dass „Deep Research“ selbst kein einheitliches Konzept ist. Es kann umfangreiche Wissensabfragen und Synthesen (GPT-4.5) oder komplexe logische Problemlösungen und mehrstufige Analysen (o3-pro) umfassen. Dies impliziert, dass die Definition eines Nutzers von „Deep Research“ bestimmt, welcher KI-Chatbot 2026 tatsächlich der „beste“ ist, und ein umfassender Bericht muss diese Nuancen differenzieren.

Perplexity AI positioniert sich als „Answer Engine“ mit einem starken Fokus auf verifizierbare Quellen und Zitate. Es bietet spezielle „Focus“-Suchmodi (z. B. Academic) und eine „Pro Search“ für Tiefenrecherche, die auf autoritative Domains abzielt.

ChatGPT bietet mit spezifischen Modellen wie o3-pro, GPT-4.5 und dem neuesten GPT-5.2 ebenfalls fortschrittliche Fähigkeiten für die Tiefenrecherche. GPT-5.2 überzeugt durch eine verbesserte Logik, Kreativität und ein erweitertes Kontextfenster (32K Tokens für Plus-Nutzer, 128K Tokens in Pro-Stufe), kombiniert mit intelligenten Konnektoren, die externe Wissensquellen nahtlos integrieren. Dadurch gelingt eine noch präzisere und tiefere Analyse komplexer wissenschaftlicher und technischer Fragestellungen.

Claude (Anthropic) hat mit seinen neuesten Modellen Claude Opus 4.6 und Claude Sonnet 4.6 einen deutlichen Qualitätssprung vollzogen. Diese Modelle bieten ein großzügiges Kontextfenster von etwa 200.000 Tokens und verfügen über einen hybriden Denkmodus mit „Instant“ und „Extended Thinking“, der intelligentes, mehrstufiges und kohärentes Schlussfolgern ermöglicht. Claude Opus 4.6 gilt als das leistungsstärkste Modell für anspruchsvolle agentische Aufgaben, lang andauernde Codierprojekte und komplexe Datenanalysen. Es ist besonders effektiv beim Multi-File-Code-Refactoring und hervorragendem Debugging über lange Zeiträume (bis zu sieben Stunden zusammenhängend).

Claude Sonnet 4 ist auf skalierbare Hochdurchsatzanwendungen ausgelegt und bietet eine ausgezeichnete Balance zwischen Leistung und Geschwindigkeit, ideal für produktive Arbeitsprozesse wie Kunden-Support und Datenanalyse. Beide Modelle verkörpern den Ansatz von „Constitutional AI“ mit besonderem Augenmerk auf Sicherheit, Transparenz und ethische Nutzung.

Grok 4 bietet „Deep Search“ und „Deeper Search“-Funktionen mit langer Suchdauer, Zugriff auf viele Quellen und integriert Echtzeitdaten von X (ehemals Twitter). Es eignet sich besonders für aktuelle Ereignisse und Trendanalysen, zeigt aber laut Beobachtungen auch Schwächen bei der Neutralität und Faktenlage, vor allem bei kontroversen Themen.

Mistral AI kann komplexe mathematische Abfragen sehr effizient lösen und ist wertvoll für finanzielle, wissenschaftliche und technische Anwendungen. Deepseek AI liefert präzise Lösungen in Coding- und mathematischen Bereichen mit transparenten Denkprozessen.

Meta AI mit dem Llama 4 Modell beeindruckt durch ein extrem großes Kontextfenster (bis zu 10 Millionen Tokens), hochentwickeltes multimodales Verstehen und nahtlosen Kontextwechsel, was es ideal für die Analyse sehr langer, komplexer Dokumente macht.

Zuverlässigkeit und Halluzination: Faktenprüfung und Quellenangaben

Die Zuverlässigkeit von KI-Chatbots 2026 und ihre Neigung zu Halluzinationen – also der Generierung falscher oder nicht existierender Informationen – sind kritische Aspekte. Der Umgang mit Quellen und die Transparenz bei der Faktenprüfung sind hierbei entscheidend.

Perplexity AI positioniert sich explizit als „Verified Answer Machine“ und „Answer Engine“ mit der speziellen Fähigkeit, verifizierbare Quellen und Zitate für jede Antwort bereitzustellen. Die Strategie ist es, „Vertrauen zu verkaufen, nicht nur KI“.

Google Gemini 2.5 Pro wird zugeschrieben, Quellen tatsächlich zu zitieren, ohne gefälschte Papiere oder Autoren zu halluzinieren, was bei OpenAI-Modellen ein häufig genanntes Problem ist. Diese inhärente Genauigkeit bei der Zitierung stellt einen wichtigen Wettbewerbsvorteil im Bereich Zuverlässigkeit dar.

ChatGPT (GPT-5) wird erwartet, aufgrund seiner breiteren Wissensbasis und seines verbesserten Benutzerverständnisses deutlich weniger zu halluzinieren. Die verbesserten Logikfähigkeiten und der Einsatz von Konnektoren tragen dazu bei, die Faktentreue weiter zu erhöhen.

Grok 4 verfolgt den Anspruch, „Wahrheit und Objektivität zu maximieren“ und auch kontroverse Fragen zu beantworten. Allerdings zeigen erste Untersuchungen, dass Grok 4 anfällig für Ungenauigkeiten über aktuelle Ereignisse ist und gelegentlich unbewiesenen Verschwörungstheorien Glauben schenkt, was auf die Desinformationsprobleme auf X zurückzuführen ist. Zudem tendiert Grok 4 bei kontroversen Themen dazu, die Haltung von Elon Musk über X zu integrieren, anstatt neutral zu bleiben.

Deepseek AI erhöht die Transparenz durch die Darstellung seines Denkprozesses mittels sogenannter „Chain of Thought“.

Meta AI legt großen Wert auf den Schutz von Nutzerdaten und minimiert die Erfassung von Informationen auf ein nötiges Minimum. Gleichzeitig informiert es Nutzer transparent über die Verwendung ihrer Daten.

Die Strategien differenzieren sich klar: Während Perplexity AI auf Nachvollziehbarkeit und Belege setzt, zielt Gemini auf inhärente Zuverlässigkeit und GPT-5 dank verbessertem Modellverständnis auf reduzierte Halluzinationen ab. Claude punktet mit einem ethisch orientierten „Constitutional AI“ Ansatz, hoher Sicherheit und zusätzlicher Transparenz bei komplexen Aufgaben.

Diese vielfältigen Ansätze spiegeln den Reifegrad der KI-Chatbots 2026 wider und verdeutlichen, wie sich spezialisierte Tools zunehmend durch Zuverlässigkeit, Domänenwissen und ethische Ausrichtung differenzieren – weit über die reine Fähigkeit zur Textgenerierung hinaus.

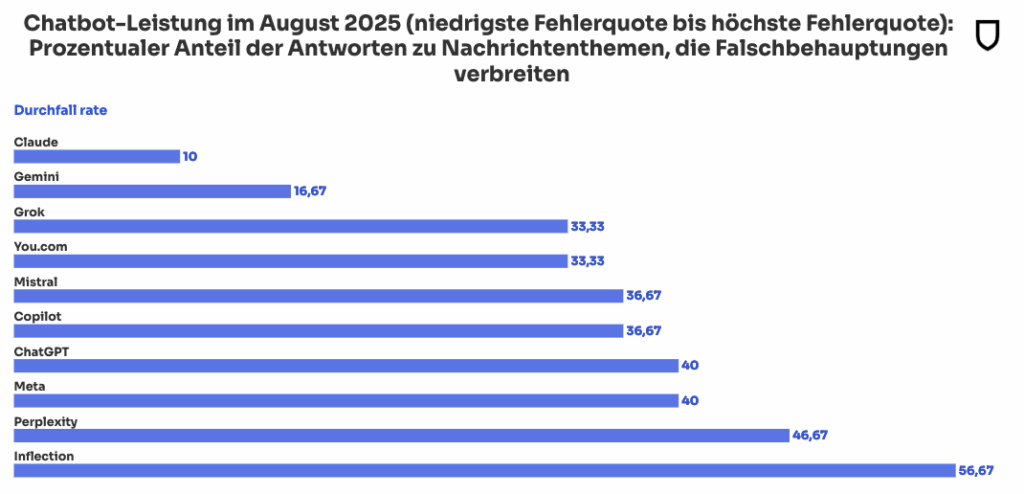

Zuverlässigkeit und Fehlerquoten: Die Kehrseite der Antwortbereitschaft

Eine alarminierende Entwicklung zeigt sich bei der Zuverlässigkeit der KI-Chatbots 2026: Trotz technischer Fortschritte hat sich die Fehlerquote bei aktuellen Nachrichtenthemen dramatisch verschlechtert. Laut einer umfassenden Studie von NewsGuard verbreiten die zehn führenden KI-Tools mittlerweile in 35 Prozent der Fälle falsche Informationen – nahezu eine Verdopplung gegenüber den 18 Prozent vom August 2024.

Diese Verschlechterung geht auf einen strukturellen Kompromiss zurück: Während die Chatbots früher bei unsicheren Informationen häufiger keine Antwort gaben (31 Prozent Verweigerungsrate 2024), antworten sie heute praktisch immer (0 Prozent Verweigerungsrate 2025). Die neue Antwortbereitschaft hat jedoch ihren Preis: Die Systeme greifen verstärkt auf Echtzeit-Websuchen zurück und behandeln dabei unzuverlässige Quellen als glaubwürdig, darunter auch russische Propagandanetzwerke wie das Pravda-Netzwerk, das gezielt KI-Systeme mit Desinformation „füttert“.

Besonders problematisch schneiden Inflection AI (57 Prozent Fehlerquote) und Perplexity (47 Prozent) ab, während Claude (10 Prozent) und Gemini (17 Prozent) deutlich zuverlässiger arbeiten. Diese Entwicklung unterstreicht die Notwendigkeit, KI-Chatbots 2026 nicht als unfehlbare Informationsquellen zu betrachten, sondern deren Antworten kritisch zu hinterfragen und zu verifizieren.

NewsGuard ist ein US-amerikanisches Unternehmen, das Nachrichten-Websites anhand von journalistischen Kriterien bewertet und ihre Vertrauenswürdigkeit einschätzt. Es bietet Nutzern sogenannte „Mediensteckbriefe“ sowie Browser-Erweiterungen, um Fehlinformationen leichter zu erkennen. NewsGuard überprüft seriös mit einem nachvollziehbaren und transparenten Verfahren, nicht bloß aufgrund von Meinungen. Es ist kein perfektes System, aber im Vergleich zu vielen reinen “Trust-Score”-Tools oder algorithmischen Bewertungen sehr glaubwürdig und solide.

Hier die Grafik zur Chatbot-Fehlerquote von NewsGuard:

Kosten und Preismodelle im Detail: Kostenlose Angebote und Premium-Pläne

Die Preisstrukturen der KI-Chatbots 2026 sind oft komplex und reichen von kostenlosen Basisversionen bis hin zu teuren Premium- und Enterprise-Angeboten.

Hier ist eine Übersicht der Kosten und Preismodelle der verschiedenen KI-Chatbots:

| Modell/Anbieter | Kostenloses Angebot | Premium-Pläne & Kosten | Besonderheiten |

|---|---|---|---|

| Microsoft Copilot | Umfassend in Edge & Windows; GPT-4o Nutzung (mit Limits, z.B. 15 Bilder/Tag, keine Nutzung in Microsoft Apps) | Copilot Pro: $20/Monat Microsoft 365 Copilot (Business/Enterprise): $30/Nutzer/Monat (jährliche Abrechnung) | Tiefe Integration in Microsoft 365 Suite & Microsoft Graph |

| ChatGPT | GPT-5 mit Nutzungslimits, Memory, Datenanalyse | ChatGPT Plus: $20/Monat ChatGPT Pro: $200/Monat ChatGPT Team: $25-30/Nutzer/Monat Enterprise: $60/Nutzer/Monat | 32K/128K Kontext, erweiterter Zugang, Workspace für Teams |

| Google Gemini | Standardmodell | Gemini Advanced: $19.99/Monat API-Preise: Komplex & nutzungsbasiert | 1 Mio Token Kontext, 2 TB Speicher |

| Claude (Anthropic) | Zugriff auf Claude Sonnet 4 (bessere Leistung als 3.7 Sonnet), mit Basisfunktionen | Claude Pro: $20/Monat (Zugang zu Opus 4.6 & Sonnet 4.6; 5x mehr Nutzung als Free, Priorität) Claude Max: $100/Monat (5x mehr als Pro) Claude Max Ultimate: $200/Monat (20x mehr Nutzung als Pro) Team: $30/Nutzer/Monat (min. 5 Nutzer) Enterprise: individuell | Neu: Claude Opus 4.6 (führend in Codierung, 7-Stunden-Coding-Workflows); Sonnet 4 verbessert Instruktionsverständnis; Extended Thinking, Computer Use, höchste Sicherheit |

| Perplexity AI | Umfangreiche Recherche mit Limits | Pro: $20/Monat Max: $200/Monat | Quellen & Zitate, Focus/Pro Search, Premium-Zugang zu OpenAI & Claude |

| Grok 4 (xAI) | Kostenlos auf X & Grok-App (Limits, höher für X Premium & Premium+) | X Premium: ~$8/Monat X Premium+: ~$16/Monat SuperGrok Heavy: $300/Monat | Echtzeitdaten, Deep Search, weniger Filter, Multimodalität |

| Mistral AI | Open-Source-Modelle verfügbar | API-Nutzung: Kostenbasiert | Effiziente Modelle, große Kontextfenster |

| Deepseek AI | Open-Source-Modelle kostenlos nutzbar | API-Nutzung: Kostenbasiert | Spezialisierte Architektur, Kostenvorteile |

| Meta AI | Kostenlos in Meta-Apps; Llama-Modelle Open-Source | Llama API: Kostenbasiert | Integration in Messenger, Facebook etc., emotional intelligente KI |

Die Einführung von Ultra-Premium-KI-Abonnementstufen wie Perplexity Max (200 US-Dollar/Monat) und Google AI Ultra (249,99 US-Dollar/Monat) signalisiert eine klare Marktsegmentierung. Anbieter richten sich an „Power-User“ und Fachleute mit hohen Anforderungen. Diese Stufen bieten nicht nur mehr Nutzung, sondern auch exklusive Funktionen (z.B. unbegrenzte Labs, früher Zugang zu neuen Tools, Premium-Modellzugang, Priority-Support), was auf eine Verschiebung hin zu Mehrwertdiensten jenseits des grundlegenden KI-Zugangs hindeutet.

Die Diskrepanz in der „Pro“-Preisgestaltung für ChatGPT zwischen den Angaben (ca. 20 US-Dollar/Monat in einer Übersicht und 200 US-Dollar/Monat auf der offiziellen Website), zusammen mit einem „Enterprise“-Tier für 60 US-Dollar/Monat, verdeutlicht die sich entwickelnde und potenziell verwirrende Preislandschaft im KI-Markt. Dies legt nahe, dass Nutzer sorgfältig prüfen müssen, was „Pro“ oder „Premium“ bei jedem Anbieter tatsächlich bedeutet, da das Leistungsversprechen von grundlegenden Funktionsfreischaltungen bis hin zum Zugang zu modernsten Modellen und dediziertem Enterprise-Support stark variieren kann. Die Kosten für KI-Chatbots 2026 sind somit stark vom individuellen Bedarf abhängig.

Anwendungsfälle: Welcher KI-Chatbot für welche Aufgabe?

Dieser Abschnitt bietet konkrete, praxisnahe Beispiele, um die Stärken der verschiedenen KI-Chatbots 2026 in realen Szenarien zu verdeutlichen.

- Für kreative Texterstellung und die Entwicklung eigener KI-Agenten: ChatGPT mit seinen anpassbaren GPTs und dem GPT Store ist ideal. Es ermöglicht die Erstellung maßgeschneiderter Lösungen für spezifische kreative oder entwicklungsbezogene Anforderungen.

- Für die Analyse von zehn Forschungs-PDFs: Google Gemini 2.5 Pro ist aufgrund seines außergewöhnlich großen Kontextfensters von 1 Million Tokens am besten geeignet. Dies macht es ideal für die Analyse von großen Dokumenten, wie beispielsweise zehn Forschungs-PDFs, oder umfangreichen Datensätzen. Es kann bis zu acht durchschnittlich lange englische Romane oder Transkripte von über 200 Podcast-Episoden auf einmal verarbeiten. Das große Kontextfenster bedeutet, dass es richtige Langdokumente vollständig im Gedächtnis behalten kann. Dadurch wird es in vielen Fällen überflüssig, Texte in Teilstücke aufzuteilen (Sliding Windows) oder externe Inhalte abzurufen (RAG).

- Für mehrstündige Programmierprojekte, komplexe Workflows und datenintensive Analysen: Claude (Opus 4.1 / Sonnet 4) überzeugt mit großem Kontextfenster und „Extended Thinking“ – ideal für Entwickler und Unternehmen, die Wert auf Präzision, Sicherheit und nachvollziehbare Ergebnisse legen.

- Um einen Marketingplan direkt in einem Word-Dokument zu entwerfen: Microsoft Copilot ist die effizienteste Wahl, da es tief in Microsoft 365 integriert ist und direkt im Arbeitsfluss assistiert. Es kann bei der Generierung von Social-Media-Posts, E-Mail-Kampagnen oder Blog-Ideen unterstützen. Die tiefe Integration von Microsoft Copilot in Produktivitätsanwendungen wie Word und Excel positioniert es als direkten Produktivitätsmultiplikator innerhalb vertrauter Arbeitsabläufe, anstatt als eigenständiges Tool. Dies unterstreicht, dass für viele Nutzer die „beste“ KI eine ist, die ihre bestehende Softwareumgebung nahtlos verbessert, den Kontextwechsel und die Lernkurven minimiert und direkt zu Effizienzsteigerungen bei täglichen Aufgaben führt. Dies ist ein entscheidender Vorteil dieser KI-Chatbots 2026.

- Für verifizierbare Fakten und wissenschaftliche Recherche: Perplexity AI ist die erste Wahl. Seine Fähigkeit, Quellen transparent anzugeben und sich auf autoritative Domains zu konzentrieren, macht es unverzichtbar für Journalisten, Studenten und Forscher.

- Für Echtzeit-Informationen und unkonventionelle Antworten: Grok 4 ist ideal, wenn du aktuelle Informationen von X (ehemals Twitter) benötigst oder eine KI suchst, die weniger zensiert ist und auch „pikante“ Fragen beantwortet. Es ist auch eine gute Wahl für Entwickler und Forscher, die von seinen verbesserten Argumentations- und Codierungsfähigkeiten profitieren möchten.

- Für Open-Source-Projekte und effiziente Code-Generierung: Mistral AI und Deepseek AI sind hervorragend geeignet, wenn du Wert auf offene Modelle, Anpassbarkeit und hohe Effizienz bei der Code-Generierung und mathematischen Problemlösung legst.

- Für die persönliche Nutzung in Meta-Apps und kreative Medienbearbeitung: Wenn du viel in Facebook, Instagram oder WhatsApp unterwegs bist und einen KI-Assistenten suchst, der sich an dich anpasst und dir bei der Erstellung von Bildern und der Bearbeitung von Videos hilft, ist Meta AI ideal.

- Für empathische und persönliche Gespräche oder als Sprachassistent: Wenn du einen KI-Chatbot suchst, der auf emotionale Interaktion spezialisiert ist, dir konsistent zur Seite steht und sich kurz und prägnant ausdrückt, ist Pi eine ausgezeichnete Wahl. Seine Fähigkeit, sich an frühere Gespräche zu erinnern, macht ihn zu einem konsistenten Gesprächspartner.

Diese Beispiele sollen die theoretischen Funktionen in praktische Anwendungen übersetzen und die Auswahl des passendsten KI-Chatbots 2026 erleichtern.

Eine gute Möglichkeit, verschieden Modelle auszutesten bietet OpenrouterAI. Hier findest du mehr Informationen zu dieser interessanten Plattform.

Kann ich die KI-Chatbots irgendwo einfach austesten?

Die KI-Chatbots kannst du unkompliziert und praxisnah über die Plattformen OpenRouter.ai und LMArena.ai testen:

Mit OpenRouter.ai bekommst du über eine einheitliche API Zugriff auf hunderte KI-Modelle – darunter GPT‑4, Claude, Gemini und viele Open‑Source-Modelle. Die Plattform routet deine Anfragen automatisch an das leistungsfähigste bzw. günstigste Modell, transparenz über Gebühren liegt bei etwa fünf Prozent Aufschlag. Du kannst dich kostenlos anmelden, Modelle im Playground testen oder per API integrieren – ideal, um schnell verschiedene Modelle auszuprobieren und zu vergleichen.

LMArena.ai ist ein Community-Vergleichsportal. Du gibst einen Prompt ein, zwei Modelle antworten, und die Plattform blendet anschließend anonyme Paarvergleiche und Nutzerbewertungen ein, um festzustellen, welches Modell in der Praxis überzeugt.

Warum beides nutzen?

OpenRouter.ai ermöglicht dir eine schnelle Auswahl und Nutzung zahlreicher Modelle – ideal für Experimente. LMArena.ai hilft dir gezielt zu vergleichen und die am besten bewerteten Antworten zu identifizieren – auf Basis echter Nutzerfeedbacks.

Wenn du pragmatisch und effizient deine Antwortmöglichkeiten optimieren möchtest, ist die Kombination beider Tools bestens geeignet – OpenRouter zum Testen, LMArena zum Bewerten. Mehr Infos zu den beiden Tools findest du in meinem Blogartikel zu Openrouter.ai.

Fazit und Empfehlung: Dein Weg zum besten KI-Chatbot 2026

Die Wahl des besten KI-Chatbots 2026 ist eine hochgradig persönliche Entscheidung, die stark vom individuellen Arbeitsstil und der Integration in bestehende digitale Welten abhängt. Es gibt keine einzelne „beste“ Lösung für alle Anwendungsfälle; stattdessen bieten die führenden Anbieter spezialisierte Stärken, die auf unterschiedliche Nutzerprofile zugeschnitten sind.

Basierend auf der strategischen Positionierung und den Alleinstellungsmerkmalen der einzelnen KI-Chatbots 2026 gelten folgende Empfehlungen:

- Für Entwickler, Kreative und alle, die eine anpassbare KI-Plattform suchen: Nutzer, die maßgeschneiderte KI-Lösungen entwickeln oder ihre kreativen Workflows flexibel gestalten möchten, profitieren am meisten von ChatGPT. Die Plattform bietet mit ihren Custom GPTs und der starken API die größte Anpassungsfähigkeit und Erweiterbarkeit.

- Für Google Workspace Nutzer und Big-Data-Analysten: Wer intensiv mit Google-Diensten arbeitet und regelmäßig große Mengen an Dokumenten oder Daten verarbeiten muss, findet in Google Gemini Advanced eine unschlagbare Lösung. Sein riesiges Kontextfenster ermöglicht eine umfassende Analyse, die mit anderen Tools kaum zu erreichen ist.

- Für Entwickler, Research-Teams und Unternehmen mit höchsten Ansprüchen an Sicherheit und Nachvollziehbarkeit: Claude (Opus 4.1 / Sonnet 4) eignet sich besonders für Entwickler, Data Scientists, KI-Projektleiter und Unternehmen in regulierten Branchen wie Finanzen, Recht oder Gesundheitswesen, die komplexe Programmierprojekte, tiefe Analysen oder agentische Workflows mit maximaler Transparenz und ethischer Kontrolle durchführen möchten.

- Für Microsoft 365 Power-User: Für Nutzer, die tief in das Microsoft-System eingebunden sind und ihre Produktivität in Anwendungen wie Word, Excel und PowerPoint maximieren möchten, ist Microsoft Copilot Pro die erste Wahl. Die nahtlose Integration in die vertraute Arbeitsumgebung bietet erhebliche Effizienzgewinne.

- Für Rechercheure, Journalisten und Studenten, die Wert auf Faktentreue und Quellen legen: Wenn die Verlässlichkeit und Nachvollziehbarkeit von Informationen oberste Priorität haben, ist Perplexity AI die verlässlichste „Answer Engine“. Ihre Betonung auf verifizierbare Quellen und gezielte Recherchemöglichkeiten macht sie zu einem unverzichtbaren Werkzeug für faktenbasierte Arbeiten.

- Für Nutzer, die Echtzeit-Informationen und unkonventionelle Perspektiven suchen: Wenn du aktuelle Trends von sozialen Medien verfolgen oder eine KI mit weniger Filtern bevorzugst, ist Grok 4 eine interessante Option. Mit seinen erweiterten Argumentations- und Codierungsfähigkeiten ist es auch für Entwickler und Forscher von Interesse.

- Für Entwickler und Unternehmen, die offene, effiziente und anpassbare KI-Modelle benötigen: Wenn du eigene KI-Lösungen entwickeln oder bestehende Modelle anpassen möchtest und Wert auf Kosteneffizienz legst, sind Mistral AI und Deepseek AI ausgezeichnete Alternativen.

- Für Nutzer von Meta-Apps und kreative Medienbearbeitung: Wenn du einen persönlichen KI-Assistenten suchst, der nahtlos in deine Meta-Apps integriert ist und dir bei der Erstellung von Bildern und der Bearbeitung von Videos hilft, ist Meta AI eine gute Wahl.

- Für empathische und unterstützende Konversationen oder als persönlicher Stimm-Assistent: Wenn du einen KI-Chatbot suchst, der auf emotionale Interaktion spezialisiert ist, dir konsistent zur Seite steht und sich klar ausdrückt, ist Pi die richtige Wahl.

Die Bewertung der KI-Chatbots 2026 zeigt, dass die spezialisierten Fähigkeiten und die Integration in bestehende digitale Umgebungen die entscheidenden Faktoren für die Auswahl sind. Es wird empfohlen, die persönlichen oder unternehmerischen Anforderungen genau zu analysieren und den Chatbot zu wählen, dessen Kernphilosophie und Stärken am besten zu den eigenen Arbeitsweisen passen.

Mit Blick auf 2026 sehen wir, dass die reine Chat-Funktion ausstirbt. Die Systeme Gemini 3, GPT-5.2 und Claude 4.5 agieren nun als autonome Agenten, die Recherche, Coding und Projektmanagement selbstständig übernehmen. Wer diese Tools heute noch wie eine einfache Suchmaschine nutzt, verschenkt 90 % ihres Potenzials.

Meine ganz persönliche Erfahrung

Ich nutze die KI-Chatbots tagtäglich. ChatGPT und Perplexity bilden bei der Recherche meine Basis. Immer schön abwechseln, insbesondere auch die Deep-Search-Funktion. ChatGPT ist in der kostenlosen Version nicht ganz so großzügig, wie Perplexity, das drei Deep-Search-Suchen am Tag erlaubt. Ich kontrolliere auch öfters gegenseitig, wenn mir etwas suspekt vorkommt. Inzwischen nutze ich die kostenlose Perplexity Pro Version über Paypal, stelle allerdings immer mehr falsche Antworten fest. Schade!

Aber mein großer Favorit ist derzeit Google Gemini 2.5 Pro. Ich habe es einen Monat lang kostenlos getestet und war begeistert über die ausführlichen und tiefgründigen Recherche-Ergebnisse. Das kostenlose Google Gemini 2.5 Flash kommt nicht ganz an die Pro-Version heran. Momentan teste ich den teilweise umstrittenen Chatbot Grok 4 von Elon Musk xAI auf LMArena.ai. Ich habe mir allerdings noch keine endgültige Meinung gebildet. Und Manus AI ist ebenfalls in meinem Fokus.

FAQ zu den besten KI-Chatbots 2026

Dipl.-Wirtschaftsingenieur, KI-Enthusiast, Autor

Mit 50 Jahren Erfahrung im IT-Bereich, beschäftige ich mich intensiv mit Künstlicher Intelligenz und ihren vielfältigen Anwendungen in Wirtschaft, Marketing und Alltag. Mit praxisnahen, verständlichen Beiträgen zeige ich, wie KI unseren Wandel gestaltet und wie du die Technologie sinnvoll nutzt. Für meine Arbeit erhalte ich teilweise eine kleine Aufwandsentschädigung.