Veröffentlicht: 28.04.2026

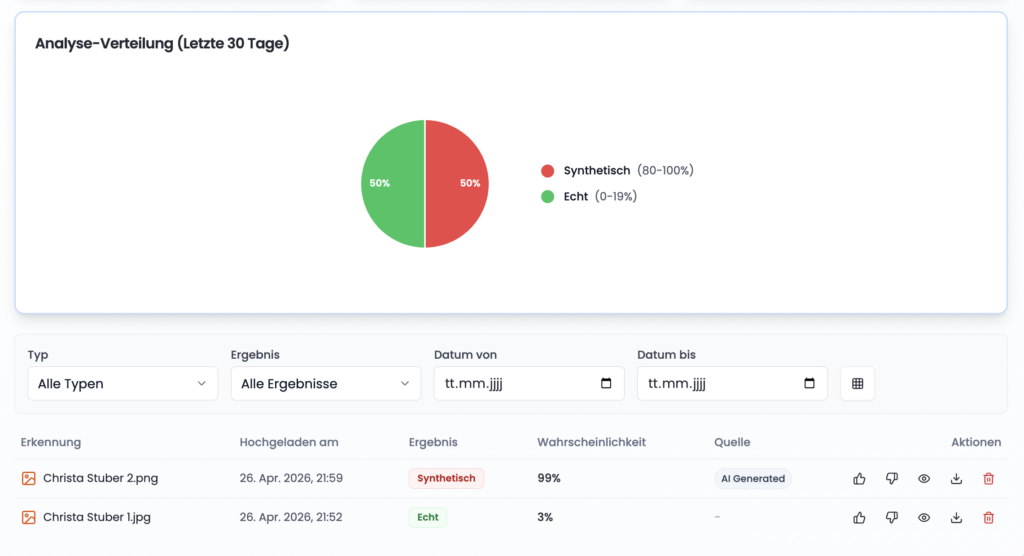

Fake‑Bilder zu erkennen, war vor zwei Jahren noch vergleichsweise einfach. Für diesen Artikel habe ich testweise meinen von HeyGen mit Avatar V produziertes KI‑Avatar‑Video und mein von ChatGPT Images 2.0 erzeugtes KI‑Profilfoto durch einen Detektor geschickt. Das Video wurde mit 86% als KI‑Inhalt eingestuft, das Profilbild mit 99%. Bei meinem eigenen Material hat die Erkennung also sehr gut funktioniert. Wie gut sich perfekt produzierte Fakes tarnen, lässt sich aus diesem Test noch nicht ableiten.

Und die Frage ist nicht mehr: Gibt es Fakes? Sondern: Erkennst du sie noch, bevor du draufhereinfällst?

Das Finger-Problem – und warum es kleiner wird

Lange war es einfach. Sechs Finger an einer Hand, verwischte Ohren, unlesbarer Text im Bild – und schon war klar: KI-generiert.

Das stimmt heute nur noch halb. Neuere Modelle wie GPT-5, GPT-5.5 oder aktuelle Bildgeneratoren machen deutlich weniger dieser klassischen Fehler. Hier hatte ich die wichtigsten KI-Videogeneratoren bezüglich der Hände- und Fingerproblematik untersucht. Wer jedoch glaubt, er erkennt Fakes allein am Fingercheck, irrt.

Trotzdem gibt es Merkmale, die KI bisher nicht vollständig beherrscht.

Fake Bilder erkennen – was dein Auge noch sieht

Bei Bildern – diese Details verraten den Fake:

- Hände und Finger – zu viele, zu wenige, verwachsen. Noch immer der erste Blick, den ich mache

- Haut zu perfekt – kein einziger Pore, keine Asymmetrie, kein Makel. Echte Menschen sehen anders aus

- Hintergrund inkonsistent – die Tiefenunschärfe passt oft nicht zur Szene

- Text im Bild – unleserlich, verzerrt, falsch buchstabiert. KI kann teilweise noch schlecht schreiben, was sie ins Bild einbettet

- Schmuck und Brillen – Ohrringe nicht symmetrisch, Brillengläser reflektieren falsch

- Schatten stimmen nicht – das Licht kommt aus einer Richtung, der Schatten aus einer anderen

Bei Videos – hier schaue ich zuerst hin:

- Augenbewegung und Blinzeln – zu wenig, zu starr, unnatürlicher Rhythmus

- Lippensynchronität – bei Deepfakes stimmt die Mundbewegung oft nicht exakt mit der Stimme überein

- Haare – einzelne Strähnen, die sich bewegen? KI hasst das. Oft verschwimmt es einfach

- Stimme monoton? – kein Zögern, keine Emotion, keine natürlichen Pausen

- Kurze Clips, viele Schnitte – KI kann oft nur kurze Videoabschnitte konsistent erzeugen

- Beleuchtungswechsel – Gesicht und Hintergrund haben verschiedene Lichtquellen

Die Methode SIFT – 4 Sekunden vor dem Teilen

Bevor ich etwas weiterschicke oder glaube, mache ich das konsequent:

- Stopp – kurz innehalten, bevor ich reagiere

- Investigate – Quelle prüfen: Wer hat das gepostet? Wann? Wo zuerst?

- Find better coverage – gibt es weitere Quellen, die das bestätigen?

- Trace claims – Ursprung zurückverfolgen

Klingt aufwändig. Ist es nicht. Dauert 30 Sekunden.

Das Tool, das ich getestet habe – und die Alternativen

Bevor ich Tools empfehle, teste ich sie selbst. Mit echtem Material, nicht mit Stockfotos. Nur so bekomme ich ein ehrliches Bild davon, was ein Detektor wirklich leistet – und was nicht.

Fake Bilder erkennen – das leistet TruthScan im Test

Ich wollte wissen, wie gut ein KI-Detektor wirklich ist. Also habe ich mein eigenes Material genommen und TruthScan* getestet.

Mein KI-Profilfoto, das du oben siehst, hat TruthScan* mit 99% als KI-Wahrscheinlichkeit erkannt. Und das linke Originalfoto als „Echt“ eingestuft.

Hier mein Avatar, den ich mit HeyGen*, Avatar V erstellt habe. Eigentlich sieht er ja ganz echt aus, aber TruthScan* erkennt es trotzdem als KI-generiertes Video.

Das Originalvideo konnte ich zum Vergleich leider nicht testen, da ich die Aufnahme direkt mit HeyGen* am Mac mit der eingebauten Webcam und dem Mac-Mikrofon gemacht habe.

Für wen ist TruthScan unbedingt notwendig?

TruthScan erkennt Bilder, Videos, Texte und Stimmen – alles in einer Oberfläche. Das ist praktisch, wenn du nicht für jeden Medientyp ein anderes Tool öffnen willst. Das Freemium-Modell reicht für gelegentliche Checks. Wer Fake Bilder erkennen will und das regelmäßig im Unternehmen braucht, schaut sich den kostenpflichtigen Enterprise-Plan an.

TruthScan ist nicht für den gelegentlichen Privatnutzer gebaut. Es richtet sich an:

- Unternehmen, die Bewerbungsfotos, Belege, Vertragsunterlagen oder Kundenkommunikation prüfen müssen

- Bildungseinrichtungen, die KI-generierte Einreichungen und akademisches Fehlverhalten erkennen wollen

- Behörden und Strafverfolgung, die digitale Beweismittel verifizieren

- Medien und Journalismus, die Bildmaterial vor der Veröffentlichung prüfen

- Finanz- und Versicherungsbranche, bei der gefälschte Belege, Ausweise und KYC-Dokumente ein echtes Betrugsrisiko darstellen

Die Plattform schützt laut eigenen Angaben über 250 Millionen Menschen vor KI-Betrug und ist SOC 2 Type II zertifiziert, eine unabhängige Prüfung dazu liegt mir nicht vor

Was mich überzeugt hat: Die Detailbegründung. TruthScan zeigt nicht nur einen Prozentwert – es erklärt, warum es den Inhalt als KI einstuft. Metadaten, Hauttextur, Symmetrie. Das ist lehrreich.

Was ich vermisse: Die kostenlose Version hat Limits, die schnell erreicht sind.

DSGVO-Hinweis zu TruthScan

TruthScan verarbeitet hochgeladene Inhalte – also Bilder, Videos, Texte – auf eigenen Servern und bewirbt SOC‑2‑Type‑II‑Audit, ISO‑27001 sowie einen DSGVO‑Compliance‑Rahmen. Für Nutzer im EWR gibt es einen EU‑Datenschutz‑Vertreter in Deutschland (Rickert Rechtsanwaltsgesellschaft mbH).

Wichtig für Unternehmen: TruthScan ist ein US‑Dienst. Wer Gesichter oder andere personenbezogene Bild‑/Videodaten hochlädt, braucht eine saubere Rechtsgrundlage, einen Auftragsverarbeitungsvertrag und Klarheit zur Speicherfrist. Die Standard‑Policy nennt 30 Tage Aufbewahrung mit Optionen für längere Nutzung zur Modellverbesserung – das sollte man vor produktivem Einsatz prüfen.

Alternative Tools:

Diese Tools habe ich noch nicht persönlich getestet, sie werden aber von Fachmedien empfohlen, als Alternativen je nach Anwendungsfall:

Kein Tool ist unfehlbar. Aber ein Tool plus geschultes Auge – das ist eine echte Kombination.

Was das für KMUs bedeutet

Ihr bekommt täglich Bilder von Bewerbern, Lieferanten, Partnerunternehmen. Pressefotos. Produktbilder. Social-Media-Content. Ein KI‑Bewerbungsfoto oder ein gefälschtes Beleg‑Foto lässt sich sonst schnell durchwinken.

Was davon ist echt?

Das ist keine theoretische Frage mehr. Mein KI-Avatar sah täuschend echt aus – nur die Analyse sagte: 86% KI. Wer heute Bildmaterial oder Videos nutzt, ohne sie zu prüfen, trägt ein Risiko. Das gilt für Recruiting genauso wie für Kommunikation und Marketing.

Mein Fazit nach dem Test

Visuelle Kontrolle allein reicht nicht mehr. Ein einziges Tool reicht nicht. Wer beides kombiniert – den geschulten Blick und einen Detektor – ist deutlich besser aufgestellt als die meisten Nutzer.

Die Frage ist nicht, ob du irgendwann einen Fake siehst. Die Frage ist, ob du ihn rechtzeitig erkennst.

Dipl.-Wirtschaftsingenieur, KI-Enthusiast, Autor

Mit 50 Jahren Erfahrung im IT-Bereich, beschäftige ich mich intensiv mit Künstlicher Intelligenz und ihren vielfältigen Anwendungen in Wirtschaft, Marketing und Alltag. Mit praxisnahen, verständlichen Beiträgen zeige ich, wie KI unseren Wandel gestaltet und wie du die Technologie sinnvoll nutzt. Für meine Arbeit erhalte ich teilweise eine kleine Aufwandsentschädigung.