Veröffentlicht: 12.02.2026 • Zuletzt bearbeitet: 29.03.2026

Make Langdock Integration: DSGVO-konforme KI-Automatisierung im Make AI Agent

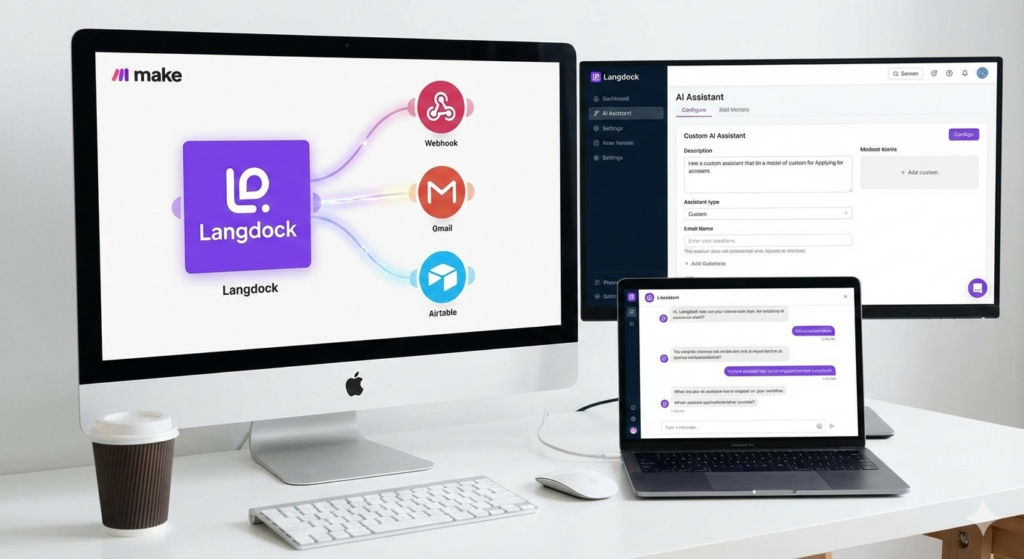

In meinem vorherigen Artikel KI-Agent Make: Ein Praxisbeispiel für intelligente Automatisierung habe ich gezeigt, wie du einen einfachen KI-Agenten in Make aufbaust, der Kundenanfragen priorisiert. Das Szenario nutzte dabei die direkt in Make* integrierte GPT-API über das Modul „Run an Agent“.

Doch was, wenn du DSGVO-Konformität wirklich ernst nimmst – oder einfach mehr Kontrolle über das genutzte KI-Modell haben willst? In diesem Artikel zeige ich, wie ich das bestehende Szenario erweitert habe: Statt der integrierten GPT-API verwendet es Langdock als KI-Tool. Diese No-Code-Automatisierung mit API-Integration ermöglicht eine sichere Datenverarbeitung in der EU.

Kurzfassung

Der Artikel zeigt, wie du Langdock über Webhooks und die API sicher und DSGVO-konform mit Make verbindest, um KI-Workflows ohne Programmieraufwand zu automatisieren.

Mit dieser Integration nutzt du Langdock als externes KI-Tool im Make AI Agent und kannst so strukturierte Datenverarbeitung und komplexe Workflows direkt aus Chats auslösen.

So entsteht eine flexible, EU-konforme Automatisierungsarchitektur für Geschäftsprozesse mit besserer Kontrolle über Modelle und Kosten.

Warum Langdock statt direkter GPT-Integration?

Der Wechsel zu Langdock ist kein „Nice-to-have“ – er ist eine strategische Entscheidung für alle, die datenschutzkonform arbeiten müssen:

| Aspekt | Make-integrierte GPT-API | Langdock über API |

|---|---|---|

| Server-Standort | USA (OpenAI) | Deutschland/EU (Langdock) |

| DSGVO-Konformität | Zusätzliche Maßnahmen nötig (SCCs) | Direkt konform |

| Datenverarbeitung | Kann zur Modell-Optimierung genutzt werden | Verbleibt im eigenen Tenant |

| Auftragsverarbeitung | Komplexer (Make → OpenAI) | Einfacher (Make → Langdock) |

| Flexibilität | Auf GPT-Modelle beschränkt | Verschiedene Modelle wählbar |

Für KMU und Agenturen ist das ein entscheidender Unterschied: Mit Langdock verarbeitest du Kundenanfragen, E-Mails oder personenbezogene Daten (fast) vollständig DSGVO-konform – ohne Kompromisse bei der KI-Leistung. Diese Workflow-Automatisierung mit EU-Datenhosting ist besonders für Kundenservice-Automatisierung im B2B-Bereich geeignet.

⚠️ Wichtig zu wissen: Fast DSGVO-konform (und warum das „fast“ zählt)

In meinem Szenario greift Langdock auf GPT-5.4 zu (OpenAI, veröffentlicht März 2026) – und hier wird es technisch interessant: Langdock hostet die Modelle nicht selbst, sondern nutzt Microsoft Azure OpenAI in Europa (z.B. Rechenzentrum Stockholm). Das bedeutet:

✅ Die Daten bleiben in der EU (Azure EU Data Boundary)

✅ Keine Nutzung für Modelltraining durch OpenAI (vertraglich garantiert durch Azure-Enterprise-Vereinbarung)

✅ Minimale Datenübertragung: Nur der Prompt und die Antwort werden übermittelt – keine Metadaten, keine User-Profile, keine Session-Logs an OpenAI

Aber: Das Modell selbst ist OpenAI GPT-5.4 – ein US-Unternehmen. Für absolut strenge Datenschutz-Puristen (z.B. bei hochsensiblen Personaldaten oder Gesundheitsdaten) ist das ein Graubereich.

Mein ursprüngliches Ziel war der Zugriff auf Mistral (französischer Anbieter, EU-Modell, EU-Training, EU-Hosting). Stand März 2026 ist Mistral in der Langdock-Workspace-UI verfügbar (Admin → Workspace → Modelle → Mistral SDK). Allerdings steht Mistral noch nicht über die Langdock Completion API (api.langdock.com) bereit – das heißt: Ein direkter API-Call wie in diesem Make-Szenario funktioniert mit Mistral aktuell noch nicht. Für den Make-Workflow bleibt GPT-5.4 über Azure EU damit die beste DSGVO-konforme Wahl.

Für die Praxis heute: Die Azure-gehostete GPT-Variante über Langdock ist deutlich DSGVO-konformer als die direkte OpenAI-API und für 95% der KMU-Anwendungsfälle (Kundenservice, E-Mail-Triage, Dokumenten-Klassifizierung) völlig ausreichend. Wer absolute Datensouveränität braucht, sollte auf Open-Source-Modelle (z.B. Llama 3 via Langdock Self-Hosting) oder eben auf Mistral warten.

Die neue Architektur: Zwei Szenarien statt einem

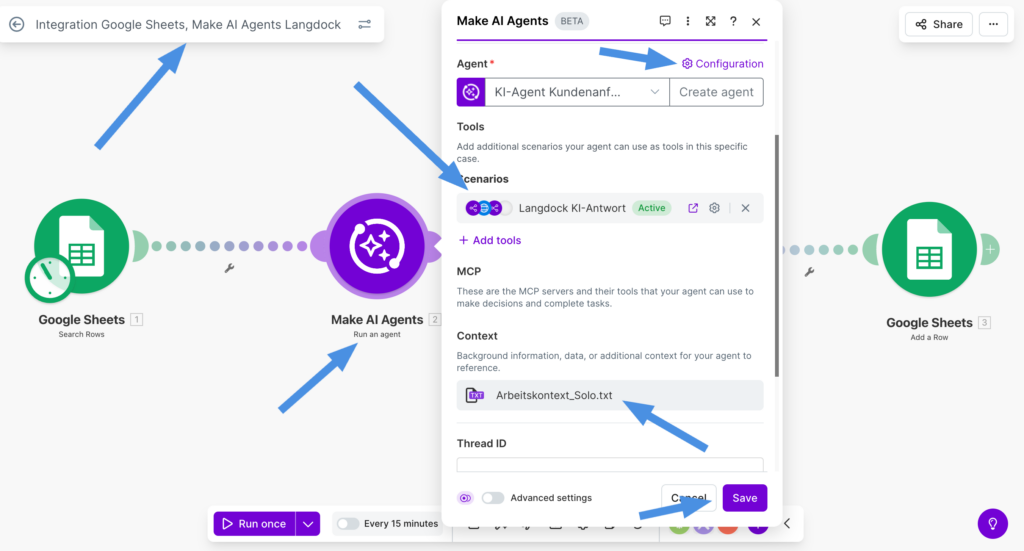

Ich habe das ursprüngliche Szenario „Integration Google Sheets, Make AI Agents“ umgewandelt in „Integration Google Sheets, Make AI Agents Langdock“. Die dabei größte technische Änderung: Statt eines einzigen Szenarios arbeiten jetzt zwei miteinander verzahnte Szenarien:

- „Integration Google Sheets, Make AI Agents Langdock“ – Der AI Agent liest die Anfragen aus dem Google Sheet ein, entscheidet, welche Aktion nötig ist und übergibt an das Szenario 2 „Langdock KI-Antwort“.

- „Langdock KI-Antwort“ – Ein separates Szenario, das als Input die Daten empfängt, die Kommunikation mit Langdock über HTTP-API übernimmt und das Ergebnis für den AI Agent bereithält. Dieser holt das Ergebnis aus dem Szenario 2 ab, parst es und schreibt es in Google Sheets.

Diese Trennung hat einen entscheidenden Vorteil: Der AI Agent bleibt der „Chef“, aber die eigentliche KI-Verarbeitung läuft über einen kontrollierten, DSGVO-konformen Kanal.

Szenario 1: Integration Google Sheets, Make AI Agents Langdock (erweitert)

Das ursprüngliche Szenario bleibt strukturell erhalten:

- Trigger: Google Sheets – Search Rows (Tab 1 mit Kundenanfragen)

- Verarbeitung: AI Agent analysiert jede Anfrage

- Unterschied: Der AI Agent nutzt nicht mehr das integrierte GPT-Modell, sondern ruft Langdock als externes Tool auf

Szenario 2: Langdock KI-Antwort (neu)

Dies ist das neue Szenario, das die Brücke zu Langdock schlägt:

Ablauf:

- Start a Szenario – Input

- HTTP-Modul – Make a request: Sendet die Anfrage an die Langdock API

- Authentifizierung: API-Key im Header (sicher in Make-Connection hinterlegt)

- Payload: Die Anfragedaten werden als JSON an Langdock übermittelt

- Antwortverarbeitung: Langdock liefert die KI-generierte Antwort zurück

- JSON-Response: Die Antwort wird strukturiert zurückgegeben

- Szenario – Return Output

Beispiel-Request (HTTP-Modul in Make):

textURL: https://api.langdock.com/v1/chat/completionsBody input method:

Method: POST

Headers:

- Authorization: Bearer [API-Key]

- Content-Type: application/jsonJSONstringBody content:

{

"model": "langdock-default",

"messages": [

{

"role": "system",

"content": "Du bist ein Assistent..."

},

{

"role": "user",

"content": "[Kundenanfrage aus dem AI Agent]"

}

]

}

Wie oben im Screenshot zu sehen ist „langdock-default“ in diesem Fall „gpt-5.4″ – das aktuelle OpenAI-Flaggschiff-Modell (März 2026), gehostet auf Azure EU via Langdock.“ und der System-Content enthält den ausführlichen Prompt, sprich die Anweisung an die KI, was zu tun ist.

Szenario 1 (Fortsetzung): Rückführung und Datenverarbeitung

Der AI Agent in Szenario 1 holt das Ergebnis aus Szenario 2 (Return Output) ab:

- Run an Agent: Der AI Agent wartet auf die Rückgabe aus dem Langdock-Szenario

- JSON Parse: Wie im ursprünglichen Setup werden die Ergebnisse strukturiert

- Google Sheets – Add a Row: Die Daten werden in Tab 2 geschrieben (Priorität, Rückfragen, empfohlene Aktion)

Schritt-für-Schritt: So funktioniert die Make Langdock Integration im AI Agent

Schritt 1: Langdock-Account und API-Key einrichten

- Langdock-Account erstellen (falls noch nicht vorhanden)

- API-Key generieren unter Einstellungen → API

Wichtig für DSGVO: Stelle sicher, dass du den Auftragsverarbeitungsvertrag (AVV) mit Langdock abgeschlossen hast. Langdock fungiert hier als Sub-Auftragsverarbeiter zu deinem Make-Account.

Schritt 2: Das Langdock-Szenario aufbauen

Das Szenario „Langdock KI-Antwort“ ist technisch einfach gehalten – es hat nur einen Job: Die Kommunikation mit Langdock. Dafür in Make eine neue HTTP-Connection mit dem Langdock-API-Key erstellen. Hier das Szenario:

Module im Szenario:

- Start a Scenario: Input

- HTTP – Make a request: Anfrage an Langdock API

- Return Output: Rückgabe an den AI Agent

Konfiguration HTTP-Modul:

- URL:

https://api.langdock.com/v1/chat/completions - Method: POST

- Headers:

Authorization: Bearer [API-Key],Content-Type: application/json - Body Type: Raw

- Content Type: JSON (application/json)

⚠️ Hinweis: GPT-5.4 nutzt die Responses API

Seit März 2026 läuft GPT-5.4 bei OpenAI intern auf der neuen Responses API, nicht mehr auf der klassischen Completion API. Langdock abstrahiert das für API-Calls über api.langdock.com/v1/chat/completions – du kannst den messages-Array wie gewohnt verwenden. Sollte Langdock künftig auf die Responses API umstellen, ändert sich der Request-Body. Prüfe im Zweifelsfall die aktuelle Langdock-Dokumentation.

Schritt 3: AI Agent als Tool-Caller konfigurieren

Im ursprünglichen Szenario „Integration Google Sheets, Make AI Agents“ habe ich den AI Agent mit dem Modul „Run an Agent“ konfiguriert und dabei das Make-interne GPT-Modell ausgewählt. Jetzt habe ich das Setup geändert:

Im AI Agent (Szenario 1):

Wie oben im Screenshot des Szenarios 1 zu sehen, habe ich als Tool das Szenario „Langdock KI Antwort“ hinzugefügt. Der System-Prompt reduziert sich jetzt auf die Anweisung an die KI, was sie mit diesem Tool machen soll:

- System-Prompt anpassen: Der Agent muss wissen, dass er Langdock als Tool nutzen soll

- Tool-Definition: Definiere ein neues Tool „Langdock KI Antwort“ mit Function Call

- Message: Übergib die Anfrage als Message an das Tool. Dies ist hier das Feld „Anfrage/Problem (B)“ aus dem Google Sheet, Tabellenblatt 1

Schritt 4: Tool-Aufruf und Ergebnis-Rückgabe

Wenn der AI Agent nun eine Anfrage bearbeitet, startet das Szenario „Start a scenario“. Dies geschieht nur nach Aufforderung durch den AI Agent. Über „Open scenario inputs“ gelangt die Kundenanfrage über das Feld email_text zu Langdock. Die Variablen Namen müssen nicht identisch sein. Im Szenario 1 hieß es noch „Anfrage/Problem (B)“ , jetzt im Szenario 2 heißt es email_text. Der AI Agent weist es korrekt zu.

- Analyse: Der Agent liest die Kundenanfrage aus Tab 1

- Tool-Entscheidung: Er entscheidet, dass Langdock aufgerufen werden muss

- HTTP-Request: Der Agent triggert das Szenario „Langdock KI Antwort“

- Warten: Der Agent wartet auf die Rückgabe

- Weiterverarbeitung: Das Ergebnis wird wie gewohnt mit JSON Parse strukturiert

System-Prompt für den Langdock-Agenten

Der System-Prompt für Langdock bleibt prinzipiell gleich – du musst nur sicherstellen, dass die Antwort im korrekten JSON-Format zurückkommt, damit Make sie weiterverarbeiten kann.

Beispiel-System-Prompt für Langdock:

{"model":"gpt-5.4","messages":[{"role":"system","content":"Du bist ein Assistent, der eingehende E-Mails von Kunden analysiert.\n\nWICHTIG:\nAntworte ausschließlich mit einem gültigen JSON-Objekt.\n\nVerwende dieses Format:\n{\"prioritaet\":\"hoch|mittel|niedrig\",\"begruendung\":\"string\",\"kategorie\":\"bestellung|reklamation|information|sonstiges\",\"empfohlene_naechste_aktion\":\"string\",\"dringlichkeit_zeit\":\"hoch|mittel|niedrig\",\"zeitkritisch\":\"ja|nein\",\"rueckfragen\":[\"string\"]}\n\nRegeln:\n1. Bei Unklarheiten verwende Sachverhalt intern prüfen\n2. Halte dich strikt an erlaubte Werte\n3. Gib IMMER alle Felder zurück\n4. Antworte NIE mit Fließtext außerhalb des JSON\n5. Keine Markdown-Formatierung"},{"role":"user","content":"{{1.email_text}}"}],"temperature":0.7}

Schritt 5: JSON Parse und Google Sheets (unverändert)

Der letzte Teil bleibt identisch zum ursprünglichen Artikel:

- Parse JSON: Extrahiere Priorität, Rückfragen und empfohlene Aktion aus der Langdock-Antwort

- Google Sheets – Add a Row: Schreibe die Daten in Tab 2

- Mapping: Verknüpfe Zeilen-ID und Kundenname aus Modul 1 mit den KI-Ergebnissen aus Modul X

Ergebnis:

Wie in der ursprünglichen Automation mit Make zur Priorisierung der Kundenanfragen steht das Ergebnis auch hier im Google Sheet im Tab 2. Der KI-Agent hat die Priorität, Folgefragen und die empfohlene Aktion zurückgeliefert. Die Kundenanfragen im Google Sheet waren dieselben, allerdings fällt das Ergebnis etwas anders aus. Das liegt auch daran, dass im ersten Beispiel das KI-Modell GPT-5.2 nicht zugänglich war, während es über Langdock ging.

Vorteile der Make Langdock Integration Integration

1. Reale DSGVO-Konformität

Während bei der direkten OpenAI-Integration die Daten in die USA übermittelt werden (auch wenn Make in der EU gehostet ist), bleiben bei Langdock alle Daten in der EU. Langdock bietet:Diese Cloud-basierte Lösung mit deutscher Auftragsverarbeitung garantiert höchste Datenschutzstandards.

- Server-Standort Deutschland

- AVV direkt verfügbar

- Keine Nutzung deiner Daten für Modell-Training

- GDPR-Compliance out-of-the-box

2. Flexibilität bei den Modellen

Langdock erlaubt oft den Zugriff auf verschiedene Modelle (je nach Vertrag). Du kannst zwischen verschiedenen KI-Modellen wählen, ohne dein Make-Szenario zu ändern – einfach durch Anpassung des Model-Parameters im API-Call.Diese Multi-Modell-Fähigkeit erlaubt den Einsatz verschiedener LLMs je nach Anforderung.

3. Bessere Kostenkontrolle

Langdock-APIs sind oft transparenter in der Abrechnung als die Make-Token-Credits. Du siehst genau, welche Kosten pro Anfrage entstehen.

4. Unabhängigkeit von Make-KI-Limits

Die Beta-Version des Make AI Agent ist auf GPT-Modelle beschränkt. Über die Langdock-Integration kannst du alternativen KI-Modellen nutzen, auch wenn Make diese nicht direkt anbietet.

Kosten und Credit-Verbrauch

Vergleich der Kosten (geschätzt für 100 Anfragen/Monat):

| Setup | Make Credits | API-Kosten | Gesamt |

|---|---|---|---|

| Direkte GPT-Integration | ~500 Credits | Inklusive | ~$0,45 (Credits) |

| Langdock über API | ~100 Credits (HTTP-Calls) | ~€2-5 (Langdock) | ~€2-5 gesamt |

Die Wahrheit: Langdock ist etwas teurer als die direkte GPT-Nutzung über Make. Aber der Preisunterschied ist für DSGVO-Konformität sowie Kundenvertrauen vertretbar.

DSGVO-Checkliste für die Langdock-Integration

- AVV mit Make abgeschlossen (für EU-Region eu2.make.com)

- AVV mit Langdock abgeschlossen

- Dokumentation im Verzeichnis der Verarbeitungstätigkeiten aktualisiert

- Datenminimierung geprüft: Nur notwendige Daten an Langdock übermitteln

- Speicherdauer definiert: Wie lange werden Ergebnisse in Google Sheets vorgehalten?

- Transparenz gegeben: Informiere betroffene Personen über KI-Nutzung (Art. 13/14 DSGVO)

- Modell-Transparenz dokumentiert: Im Verzeichnis der Verarbeitungstätigkeiten das konkret genutzte Modell (z. B. GPT-5.4 via Azure EU) sowie den Unterauftragsverarbeiter (Microsoft Azure, EU Data Boundary) benennen – nach Art. 30 DSGVO.

Fazit: DSGVO-konforme KI-Automatisierung ist machbar

Die Integration von Langdock über API in deinen Make AI Agent ist ein kleiner technischer Schritt mit großer Wirkung. Du behältst alle Vorteile der intelligenten Automatisierung – Priorisierung, Kategorisierung, Entscheidungsunterstützung – und gewinnst gleichzeitig echte DSGVO-Konformität.Diese Enterprise-Automatisierung kombiniert intelligente AI Agents mit sicherer Cloud-Infrastruktur für professionelle Workflows.

Das Setup im Überblick:

- Szenario 1 (AI Agent) liest Anfragen und ruft Langdock auf

- Szenario 2 (Langdock KI-Antwort) kommuniziert mit der Langdock API

- Parse JSON strukturiert die Ergebnisse

- Google Sheets Tab 2 speichert die Bewertungen

Für Unternehmen, die mit personenbezogenen Daten arbeiten und gleichzeitig KI-Automation nutzen wollen, ist diese Architektur der Gold-Standard: Technisch robust, legal konform und praktikabel im Tagesgeschäft.Die Kombination aus Make-Integration, API-gesteuerten Workflows und EU-konformer Datenverarbeitung bietet maximale Flexibilität für moderne Unternehmensanwendungen.

Hast du Fragen zur Integration? Kontaktiere mich auf LinkedIn – ich helfe gerne bei der Umsetzung.

Hinweis zur Haftung und Rechtslage:

Die Informationen in diesem Artikel stellen meine persönliche Einschätzung als Wirtschaftsingenieurin und langjährige IT-Praktikerin dar. Für rechtliche Bindung deiner DSGVO-Dokumentation empfehle ich die Konsultation eines Fachanwalts für Datenschutzrecht. Ich übernehme keine Haftung für die Vollständigkeit oder Aktualität der technischen Details – KI-APIs und Make-Module ändern sich schnell. Prüfe vor Produktivsetzung alle verwendeten Endpunkte und aktuelle Langdock-Dokumentation.

FAQ zur Make Langdock Integration

Was ist die Make Langdock Integration?

Die Make Langdock Integration verbindet Langdock mit Make, damit du KI-Schritte in visuellen Automationen nutzen kannst. So lassen sich Prozesse über Trigger, Actions und Searches automatisiert ausführen – ohne klassische Programmierung.

Wie richte ich einen Langdock-Workflow in Make mit Webhook oder API ein?

Du erstellst in Make einen Trigger (z.B. Webhook) oder nutzt ein Langdock-Modul und testest die Datenübergabe. Danach leitest du die Daten an weitere Apps/Module weiter und mapst Felder (z.B. Prompt, Text, ID, Status), damit der Prozess zuverlässig durchläuft.

Welche Authentifizierung ist bei der Make Langdock Integration üblich (API-Key oder OAuth 2.0)?

Je nach angebundenem Tool funktionieren Integrationen typischerweise über API-Key oder OAuth 2.0. Dadurch steuerst du Zugriffsrechte und Berechtigungen der Verbindung und kannst den Zugriff auf das Nötigste begrenzen.

Mit welchen Apps kann ich Langdock über Make verbinden?

Über Make kannst du Langdock mit über 3.000 Apps kombinieren – z.B. CRM-Systemen, E-Mail-Tools, Projektmanagement, Datenbanken und Cloud-Speichern. Damit baust du End-to-End-Automationen von der Datenerfassung bis zur Aktion in deinem Zielsystem.

Wie bleibe ich DSGVO-konform bei der Make Langdock Integration?

Übertrage nur die Daten, die der konkrete Use Case wirklich benötigt, und nutze wenn möglich Pseudonymisierung (z.B. Kunden-ID statt Klarname). Prüfe zusätzlich AVV, Speicherorte sowie Rollen- und Rechtekonzepte der beteiligten Tools, damit personenbezogene Daten geschützt bleiben.

Dipl.-Wirtschaftsingenieur, KI-Enthusiast, Autor

Mit 50 Jahren Erfahrung im IT-Bereich, beschäftige ich mich intensiv mit Künstlicher Intelligenz und ihren vielfältigen Anwendungen in Wirtschaft, Marketing und Alltag. Mit praxisnahen, verständlichen Beiträgen zeige ich, wie KI unseren Wandel gestaltet und wie du die Technologie sinnvoll nutzt. Für meine Arbeit erhalte ich teilweise eine kleine Aufwandsentschädigung.